Skip to main content

SQL Server 2014 : La CTP2 est disponible

Windows 7 Virtual Roundtable Q&A: Part Two

As noted in our previous post, our recent Springboard Series Virtual Roundtable—Windows 7: To the Beta and Beyond—with Mark Russinovich resulted in numerous viewer-generated questions on the Windows 7 Beta release that the panel was unable to address, given time limitations. Here is the second batch of questions and answers, along with links to more detailed information:

Q: Will the User State Migration Tool (USMT) support migration of settings from Windows 2000 and Windows XP to Windows 7?

- A: The USMT supports the gather process (scanstate.exe) on Windows XP, Windows Vista and Windows 7. It supports the restore process (loadstate.exe) on Windows Vista and Windows 7. Windows 2000 is not supported with USMT 4.0, but earlier versions of USMT will be available for Windows 2000 migration support. For more information on USMT, click here.

Q: Can we query this performance information (battery lifecycle, etc) remotely through Windows Management Instrumentation (WMI)?

- A: Windows 7 does include a utility called PowerCfg.exe that allows individuals to easily query common issues affecting power efficiency on a system, as well as determine the last full charge compared to full battery capacity to determine whether a battery needs to be replaced.

Q: Is Virtual Hard Disk (VHD) together with BitLocker Drive Encryption supported?

- A: No. Windows 7 Native Boot VHD does not support use with BitLocker full volume encryption.

Q: Are there any special requirements for deploying Windows 7 via Operating System Deployment (OSD)/System Center Configuration Manager?

- A: System Center Configuration Manager 2007 will support Windows 7 deployment with Service Pack 2, scheduled to be released around time of Windows 7 release to manufacturing (RTM).

Q: Is Microsoft Deployment Toolkit (MDT) 2010 backward compatible with Windows Vista and Windows XP?

- A: Yes, MDT 2010 will support Windows XP, Windows Vista and Windows 7 client operating system deployments.

Q: Is there an alternative for DirectAccess to use a full IPv6 vs 2 IPv4 addresses?

- A: DirectAccess supports native IPv6 addresses.

Q: Does/will DirectAccess support SecurID authentication?

- A: DirectAccess supports two factor authentication with smartcards.

Q: What happens if more than one user tries to modify the same file from the branch cache?

- A: BranchCache works on the read path for Server Message Block content. Write path is not supported in Windows 7.

Q: In hosted cache mode, can BranchCache work with server core or do you need the full server installed?

- A: Hosted Cache will work with server core.

Q: BranchCache in Windows Server 2008 R2 Beta seems to be broken. I can't create a shared folder that has BC enabled.

Q: Is the Problem Steps Recorder feature available on Windows Vista and Windows XP so I can show steps that work on an older operating system vs. Windows 7?

- A: No. Problem Steps Recorder is only available on Windows 7.

Q: What happens when I take a BitLocker-encrypted USB stick to a non-Windows system like OSX or Linux?

- A: The USB stick will not be accessible on OSX or Linux. You will be able to unlock the USB stick in read-only mode on Windows XP or Windows Vista, however.

Q: Is there documentation on the improvement on Remote Desktop Protocol (RDP) or Virtual Desktop Infrastructure (VDI) performance in Windows 7?

- A: We have not released performance benchmarks at this time.

Q: Will Windows 7 run on a machine designed for Windows XP?

- A: We have not yet determined final system requirements as the product is still in development. That said, one of our design principles is that Windows 7 will run well on any machine certified to run Windows Vista.

Q: When is Windows 7 Release Candidate (RC) planned to be released?

- A: The feedback we get in the early stages of Beta will help enable us to discuss the next Windows 7 milestone. Our goal with the Beta is to collect feedback and refine the features so we can deliver a great product that meets our customers' needs.

We also received several questions around the smaller Windows 7 install footprint. The reason for the smaller footprint is the omission of several features now part of Windows Live. Here is a list of this features and where they can now be found:

For more information on Windows 7 evaluation, testing and adoption, please visit the Windows 7 tab on the Springboard Series on TechNet.

Windows Service Pack Blocker Toolkit

Here's an update for those of you who have installed the Service Pack Blocker Tool for Windows XP or Windows Vista. This code temporarily prevents the installation of a service pack through Windows Update, typically for one year after general availability of the service pack. The expiration date for the Service Pack Blocker Tool for Windows Vista SP1 is April 28, 2009; for Windows XP SP3 the tool expires May 19, 2009.

For more information on the Service Pack Blocker Tool, please see the FAQ available through the Springboard Series on TechNet.

Windows Vista SP2 and Windows Server 2008 SP2 Release to Web

Today we are pleased to pre-announce the Release to Web (RTW) of Service Pack 2 (SP2) for Windows Vista and Windows Server 2008. SP2, a combined service pack for both operating systems encapsulated in a single installer, will simplify deployment, management, and support for IT Pros. It includes support for new types of hardware and emerging hardware standards, as well as updates since SP1. For specific information on what's included in SP2, visit the notable changes document.

We have posted SP2 for download on our Download Center and Windows Update. Consumers with Windows Vista SP1 can visit the Download Center or Windows Update (WU) to install SP2, but our best advice is to turn on Automatic Update (AU) and sometime during the coming months your computer will download and install SP2. Similar to previous releases, SP2 delivery over AU is a throttled release which will begin in June. Business customers who require additional time to prepare for the download and deployment of SP2 can use the same blocker tool kit provided for Windows Vista SP1 to delay deployment.

If you are a Windows Server 2008 customer that needs increased management of SP2, we recommend using Automatic Updates/Group Policy and Windows Software Update Services (WSUS). Customers who require additional time to prepare for the download and deployment of SP2 can download the blocker tool kit to prevent SP2 from installing for up to 12 months. We hope these tools will help streamline your testing and deployment of SP2.

Business customers with Windows Vista will find the transition to Windows 7 will be significantly more straightforward due to the high degree of compatibility between Windows Vista and Windows 7. If your Windows Vista SP1 deployment is already underway we recommend you continue with SP1 as planned. Then you can deploy SP2 using your systems management infrastructure. If you are in the early stages of deployment or still planning Windows Vista deployment our best advice is that you plan on testing and deploying Windows Vista SP2.

Download the Windows Server 2008 Service Pack 2 and Windows Vista Service Pack 2 here.

Windows Vista SP2 - What's Inside? What's Important?

With today's launch of the Customer Preview Program (CPP) for Windows Vista® Service Pack 2 (SP2), we wanted to provide a brief synopsis of the elements in this service pack, and encourage you to download and test this release. Windows Vista SP2 is a traditional service pack release with all cumulative released security updates available since the SP1 release in March 2008. In addition, Windows Vista SP2 includes support for new types of hardware and emerging standards that will grow in importance in coming months, along with fixes discovered via automated error reporting as part of our Customer Experience Improvement program.

What makes the Windows Vista SP2 release unique is that it represents a single service pack which applies to both client (Windows Vista SP1) and server (Windows Server 2008) operating systems—since the code base for Windows Vista is shared with that for Windows Server® 2008, a single update can be deployed across your infrastructure. This service model also provides the ability to detect an incompatible driver and block service pack installation, or warn users of any loss of functionality during installation. Other highlights for IT pros include:

Emerging Hardware Support

- Bluetooth 2.1 feature pack

- Ability to record data on Blu-ray media

- exFAT file system now supports UTC timestamps, which enables correct file synchronization across time zones

- Support for the new VIA 64-bit CPU

- Support for ICCD/CCID smart cards

Hyper-V *

- Windows Vista SP2 includes Hyper-V™ technology, enabling full virtualization of server workloads

*To clarify, Hyper-V is not included in Windows Vista SP2, it is part of the Windows Server 2008 service pack. This means that when you install SP2 for Windows Server 2008, or if you install a slipstreamed version of Windows Server 2008 with SP2, the RTM version of the Hyper-V role will be included. Hyper-V was released after Windows Server 2008, which means that the role you currently install is a pre-release role and needs to be updated to bring it up to RTM. This update will be applied (only if necessary) automatically when you install SP2.

Security

- Windows Vista SP2 incorporates previously released reliability updates, as well as addressing crashes discovered since the launch of Windows Vista SP1

Performance

- Inclusion of Windows Search 4 for improved indexing performance, improved relevancy in search, broader indexing scenario inclusion, as well as new Group Policy integration for Windows Search

- Reduction of resources required for sidebar gadgets

Wireless

- Windows Vista Feature Pack for Wireless

- Fixed issue where Wi-Fi connection was no longer available after resume from sleep

Administration and Support Improvements

- Service pack clean-up tool: Restores hard disk space by permanently deleting the previous versions of the files (Windows Vista RTM and Windows Vista SP1) that are being serviced by Windows Vista SP2

We encourage you to download this service pack and test it on your lab machines. You should find that most if not all of your applications continue to function properly with this release. Also, we should point out that either Windows Vista SP1 or Windows Server 2008 is a prerequisite for installing this service pack.

Additional information on Windows Vista SP2 can be found in the Notable Changes in Windows Server 2008 SP2 Beta and Windows Vista SP2 Beta document. For more information on deploying and managing Windows Vista and related service packs, bookmark this blog and the Windows Client TechCenter at www.microsoft.com/springboard.

12 Fantastiques - EP10 - Mise en œuvre rapide de vos applications

Découvrez cette semaine dans ce nouvel épisode des 12 Fantastiques comment mettre en œuvre rapidement vos solutions avec les Appliances SQL Server 2012, présenté par Nadia Ben El Kadi et Adrien Cayrac.

Si vous voulez tout savoir sur les fonctionnalités intégrées dans SQL Server 2012, abonnez-vous au flux RSS de ce blog pour ne rater aucun épisode !

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

[View:https://www.youtube.com/watch?v=Q8FXZh-nsGQ&feature=youtu.be]

Réduisez la complexité et accélérez le temps de mise en œuvre de votre solution avec des offres Cloud et Appliances clé en main.

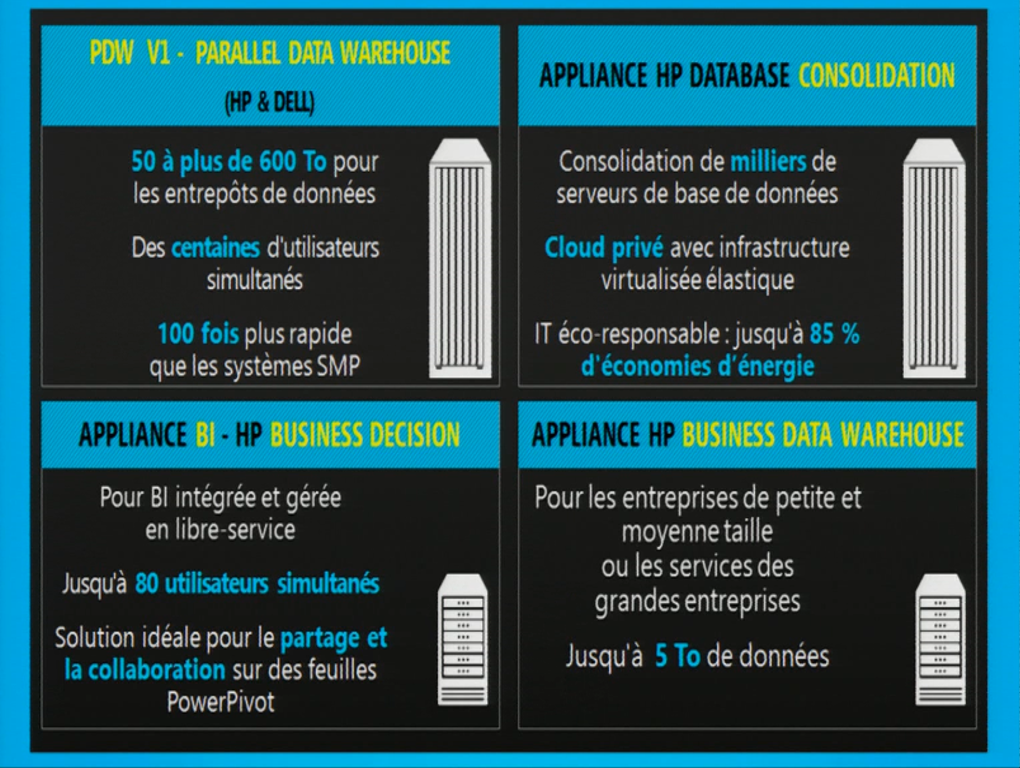

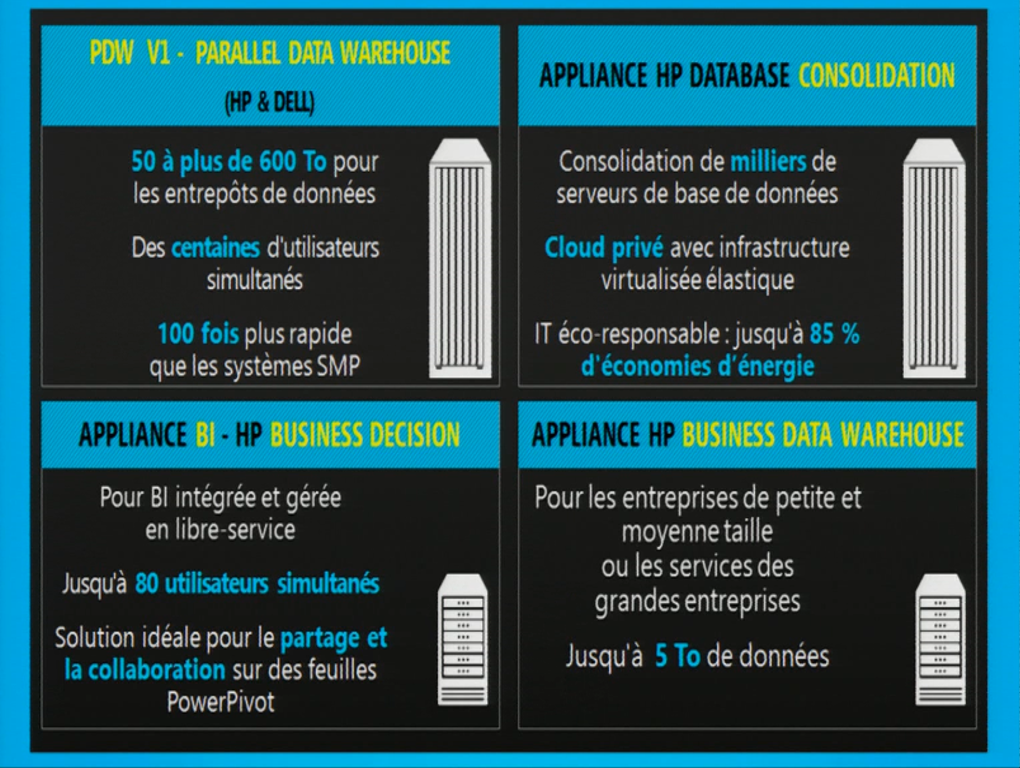

Scénarios optimisés

- Accélérez les priorités de l'entreprise avec des appliances de stockage de données de taille variable, business intelligence, consolidation et traitement des transactions.

- SQL Server offre des Appliances construites en collaboration avec HP et Dell:

- Appliance HP Enterprise Database Consolidation

- Appliance HP Enterprise Data Warehouse

- Appliance HP Business Decision

- Appliance HP Business Data Warehouse

- Appliance Dell Parallel Data Warehouse

Solutions complètes

- Microsoft collabore étroitement avec ses partenaires lors de la conception des appliances pour garantir une solution totalement intégrée, avec un support unique pour tout le matériel et les logiciels, des logiciels exclusifs améliorés pour l'appliance, le tout offrant un excellent rapport performance/prix.

Agilité

- Accélérez le temps de mise en oeuvre de la solution avec les Appliances SQL Server en éliminant le temps de concevoir, optimiser et tester tout le matériel connexe et les composants logiciels.

- Provisionnez vos bases de données en quelques minutes sans aucune administration physique ou investissement d'infrastructure avec Windows Azure SQL Database.

Pour en savoir plus :

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

12 Fantastiques – EP11 – Productivité optimisée

Découvrez cette semaine dans ce nouvel épisode des 12 Fantastiques comment optimiser la productivité de votre IT avec SQL Server 2012 et ses outils de données, présenté par Nadia Ben El Kadi et Adrien Cayrac.

Si vous voulez tout savoir sur les fonctionnalités intégrées dans SQL Server 2012, abonnez-vous au flux RSS de ce blog pour ne rater aucun épisode !

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

[View:https://www.youtube.com/watch?v=WA3JKgFBJ7k&feature=youtu.be]

Optimisez la productivité de l'IT et des développeurs dans vos environnements sur site et cloud avec des outils communs.

Création

- Outils de données SQL Server: Menez le développement de la base de données au niveau supérieur avec les outils de données SQL Server, une expérience de développement intégrée pour les développeurs qui créent le web, l'entreprise et les applications mobiles orientés données de la prochaine génération, sur site et dans le cloud public.

- Améliorations de T-SQL: Simplifiez les tâches de programmation complexes avec des améliorations T-SQL et facilitez les migrations de bases de données avec un support amélioré pour les normes ANSI SQL. En outre, le nouvel objet de séquence permet aux développeurs de lier des identifiants uniques des lignes sur plusieurs tables.

- Profitez d'un environnement de développement ouvert.

Extension

- Outils communs: construisez, étendez et gérez des bases de données ou solutions de Business Intelligence dans les environnements sur site et cloud en utilisant les mêmes outils de développement, systèmes et modèles basés sur T-SQL.

Gestion

- SQL Server Management Studio: Gérez efficacement avec une seule console pour déployer et gérer les actifs de base de données sur les serveurs, cloud privé et cloud public. En outre, utilisez SSMS pour gérer les configurations de haute disponibilité, des services BI et l'utilisation des ressources.

- Automatisez les tâches d'entretien des infrastructures, rationalisez le dépannage et le diagnostic, et optimisez les ressources matérielles avec des outils de gestion intégrés et faciles à utiliser.

- Rationalisez la gestion de la virtualisation avec System Center Virtual Machine Manager.

- Prise en charge de Windows PowerShell 2.0, automatise les tâches de gestion sur la plate-forme Microsoft.

Pour en savoir plus :

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

12 Fantastiques – EP12 – Données Réparties, Exploitables Partout

La série des 12 Fantastiques de SQL Server 2012 prend fin ! Depuis le mois d'octobre, nous vous présentons chaque mois les nouvelles fonctionnalités clés de SQL Server 2012, regroupées en 12 « Fantastiques ». Nous arrivons au bout de cette série, et vous invitons à en découvrir les derniers épisodes sur le thème du Cloud, présentés comme toujours par nos deux experts Nadia Ben El Kadi et Adrien Cayrac.

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

[View:https://www.youtube.com/watch?v=frdqRAt77Mk]

Pour ce dernier épisode des 12 Fantastiques de SQL Server 2012, nous nous intéressons aux Big Data, plus particulièrement dans le Cloud : accédez à toutes les données, relationnelles ou non-relationnelles, quelle que soit leur taille et de n'importe quel endroit avec les solutions Microsoft Big Data.

Gestion complète des données

- Prise en charge de toutes les données: Gérez et étendez les données relationnelles et non-relationnelles comprenant les données XML, fichiers Windows, et données spatiales.

Fonctionnalité de recherche améliorée

- Recherche sémantique statistique en texte intégral: Permettre aux développeurs de T-SQL d'apporter des connaissances approfondies à l'entreprise en découvrant des relations inconnues jusqu'alors, grâce aux fichiers de données non-structurées stockés dans la base de données SQL Server de l'entreprise.

Étendre de façon transparente des données

- OData: Fournir un flux de données cohérent et ouvert pour alimenter les expériences utilisateur multiples sur le Web et les appareils mobiles et fixes avec OData, un protocole ouvert construit sur ??des standards Web largement utilisés.

- Windows Azure Marketplace: Monétisez les données accumulées en publiant des données à l'achat et la consommation par d'autres entités.

- Prise en charge améliorée d'interopérabilité: Étendez les environnements hétérogènes en vous connectant à SQL Server et les applications Windows Azure SQL Database en utilisant n'importe quel API standard (ADO.NET, ODBC, JDBC, PDO, et ADO) à travers des plates-formes variées, y compris NET, C / C++, Java et PHP.

Pour en savoir plus :

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

12 Fantastiques - EP9 - Montée en charge à la demande

Le 3ème pilier de SQL Server 2012 introduit la notion de « Cloud sur mesure ». Mais que signifie-t-elle ?

Pour nous, le Cloud sur mesure renvoie à l'informatique d'entreprise hybride : vous bénéficiez de déploiements divers, les uns sur site, les autres hors site. Selon vos besoins spécifiques (stratégies, applications, innovation, multiplication des produits...), vous pouvez choisir ce qui vous convient le mieux dans chaque mode et réaliser la combinaison adaptée : pas besoin de choisir un seul type de déploiement ! Prenez le meilleur de chaque…

Pour l'heure, découvrons le premier épisode des 12 Fantastiques de SQL Server 2012 dédié au Cloud : il est consacré à la Montée en charge à la demande. Le Cloud comme vous l'entendez, avec des options de déploiement flexibles et hybrides, selon vos choix et vos besoins.

Cet épisode présenté par Nadia Ben El Kadi et Adrien Cayrac présentera en première partie le 9ème Fantastique de SQL Server 2012, puis en deuxième partie (à partir de 15:30) une démo bonus de la plateforme Windows Azure.

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

[View:https://www.youtube.com/watch?v=kaNBAUolU4A]

Quatre options s'offrent à vous lors d'un déploiement : serveur classique, cloud privé, hybride ou public. Quel que soit votre choix, Microsoft est parfaitement placé pour fournir et combiner les quatre options avec une efficacité optimale. Ne vous préoccupez plus de l'avenir, quelle que soit la solution choisie vous pourrez monter en charge selon vos besoins ; des serveurs individuels aux gros entrepôts de données, du cloud privé au cloud public ou hybride, les solutions Microsoft sont adaptées à tous les environnements de déploiement.

Montée en charge élastique

• Déploiements en libre-service : Capacité virtualisée à la demande, provisioning en libre-service et mesure de l'utilisation avec la plateforme Windows Azure et les options de cloud privé.

• Fédérations dans Windows Azure SQL Database : pour la prise en charge des scénarios d'éclatement des applications par le biais de stratégies et de tableaux de bord automatisés.

Flexibilité et Choix

• Bases de données à relation contenant-contenu : migrer de manière transparente entre les bases de données ou étendre les applications à travers les différentes instances de SQL Server et Windows Azure SQL Database avec des bases de données à relation contenant-contenu qui définissent et contiennent des schémas et des objets nécessaires pour supporter une application.

• Mobilité des Licences : Utilisez l'IT Hybride, un environnement de déploiement flexible sur serveurs et cloud, à travers les droits d'utilisation de licence uniques qui permettent aux entreprises de déplacer leurs

licences à travers serveurs, cloud privé et public.

• Synchronisation des données : permettre de nouveaux scénarios d'application hybrides créatifs, avec synchronisation des données bi-directionnelle entre les bases de données, qu'elles soient dans votre datacenter ou dans le cloud.

Pour en savoir plus :

Retrouvez le sommaire de tous les épisodes des 12 Fantastiques de SQL Server 2012

L'innovation par les données – Cycle de vie applicatif, Infrastructure de données et applicative

Cet article a pour objectif de décrire les bénéfices apportés aux entreprises par les architectures et les services basés sur le Cloud, ainsi que la méthodologie DevOps. Nous allons prendre en exemple, les besoins et contraintes d'une entreprise de commerce électronique au niveau de son IT de par sa présence et son développement à l'international.

Besoins

Agilité de l'infrastructure

Elasticité de l'infrastructure : évolution à la demande

Stockage et sécurisation de données

Réduire la complexité de gestion de l'IT

Réduction des coûts CAPEX et OPEX

Déploiement rapide des applications

Présence internationale

Problématiques

Performance de l'infrastructure

Cycle de développement

Temps de mise à disposition des infrastructures

Utilisation ponctuelle -> coût immobilisation

Réduction du "Time to market"

Gestion des données de tests, anonymisation

Volume de données

Les activités de commerce en ligne ont la particularité de devoir s'adapter très rapidement à ce marché très concurrentiel. L'entreprise doit réagir en temps réel face à son environnement et aux besoins de ses clients afin d'ajuster une stratégie, maximiser sa réactivité, minimiser le « Time to market » en étant au plus près de ses clients quel que soit le continent.

Une distribution internationale des infrastructures est nécessaire afin de conquérir de nouveaux marchés et d'être au plus près des clients pour des raisons d'optimisation des performances notamment les latences réseaux.

Le cycle de vie d'une application nécessite la mise en place de nombreux moyens afin de répondre aux multiples exigences et réussir : moyens humains, moyens matériels, moyens collaboratifs, pilotage, ….

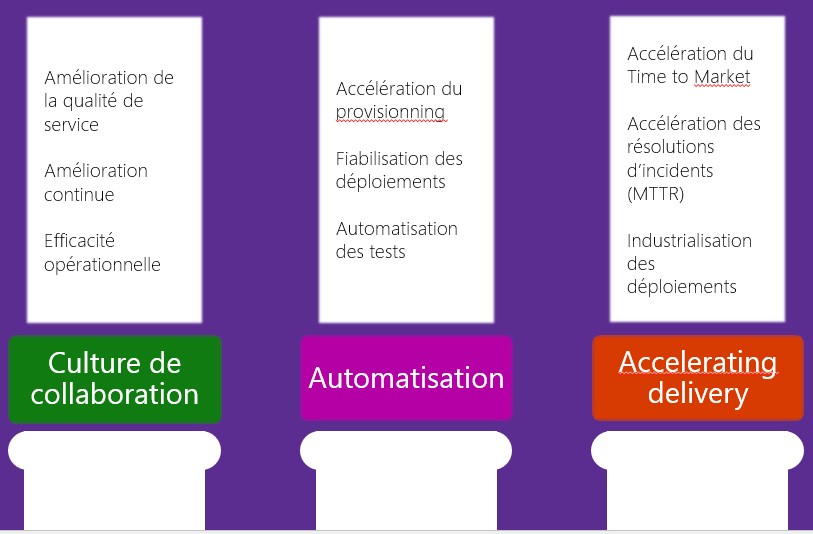

Les pratiques « DevOps » et le cloud Azure sont les moyens de cette réussite.

Ces pratiques, méthodologies peuvent s'appuyer sur les différentes briques de l'écosystème Microsoft afin de délivrer une solution transverse et complète répondant aux contraintes.

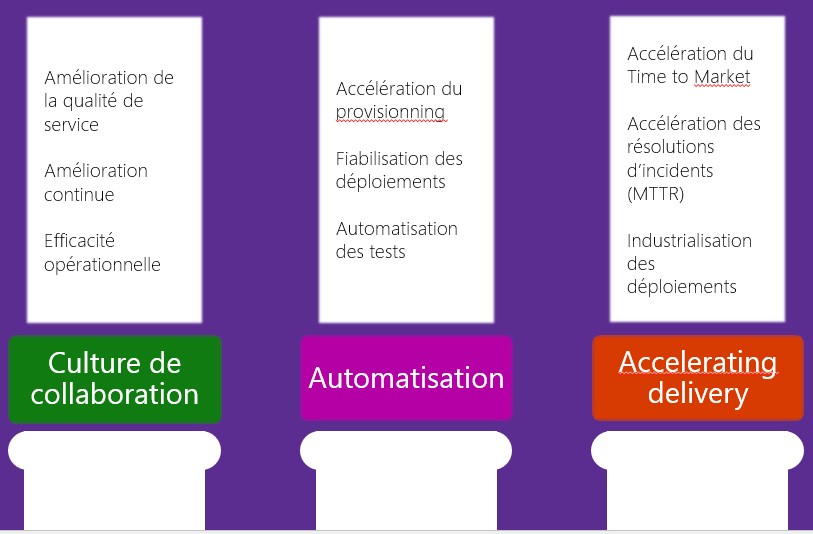

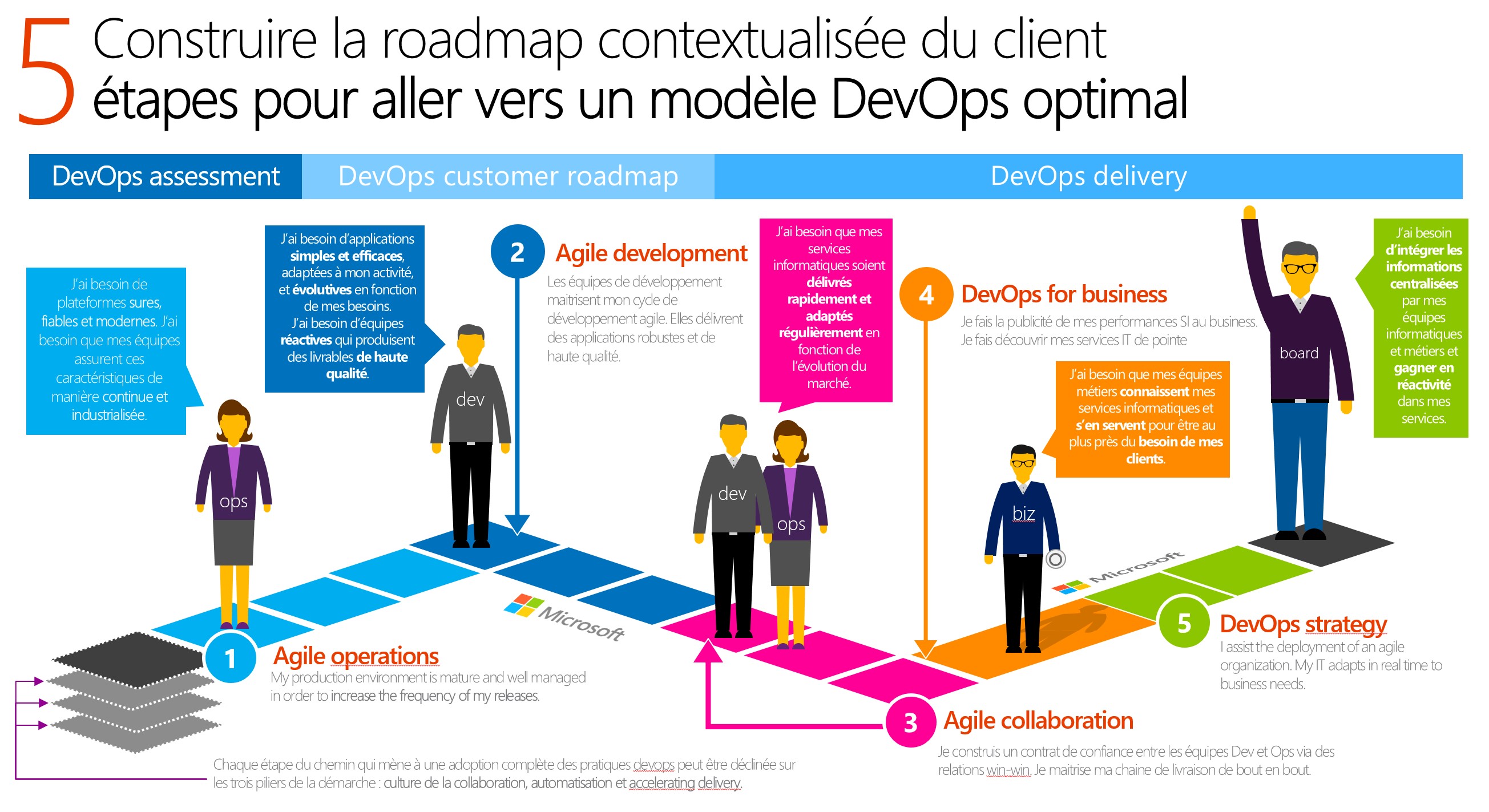

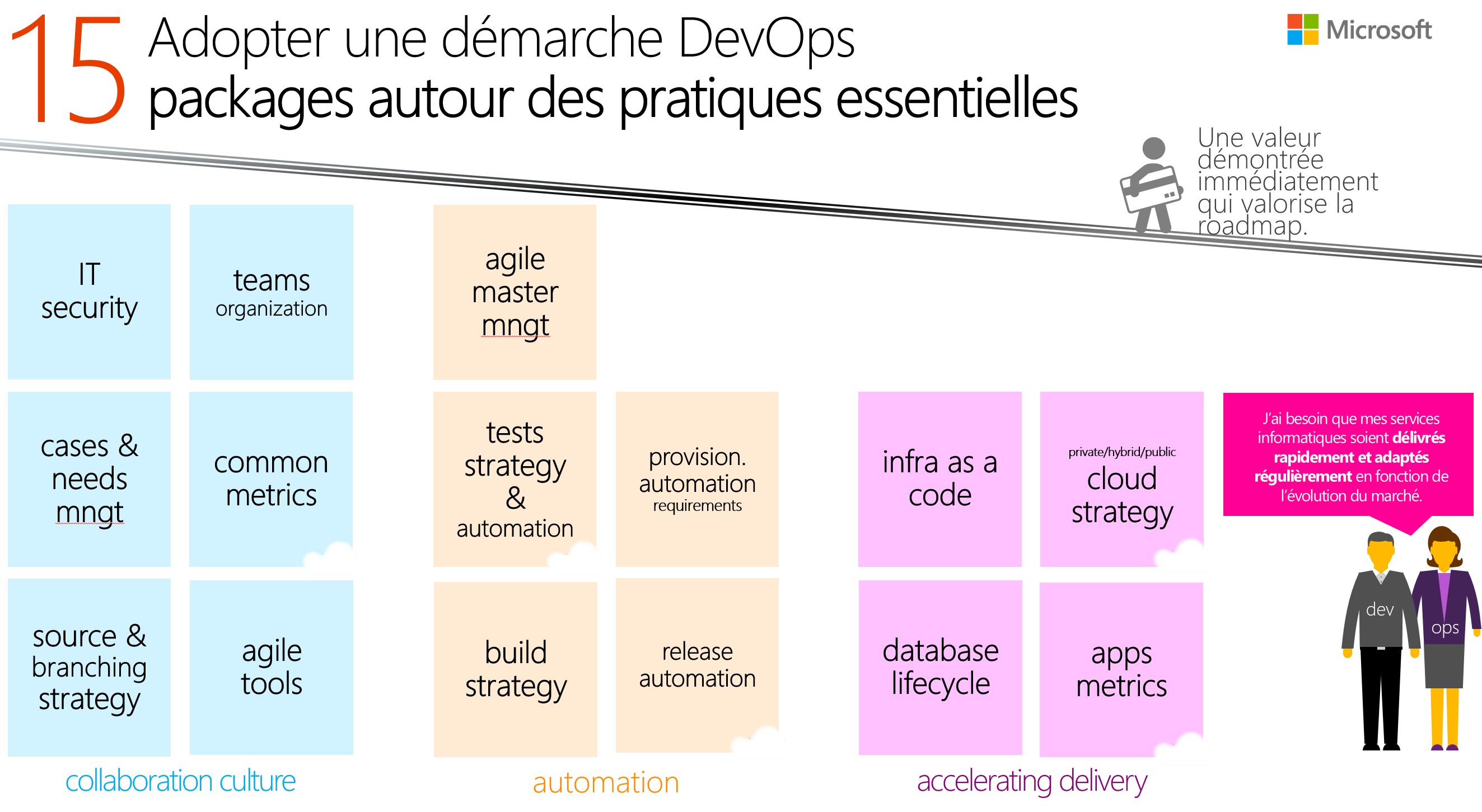

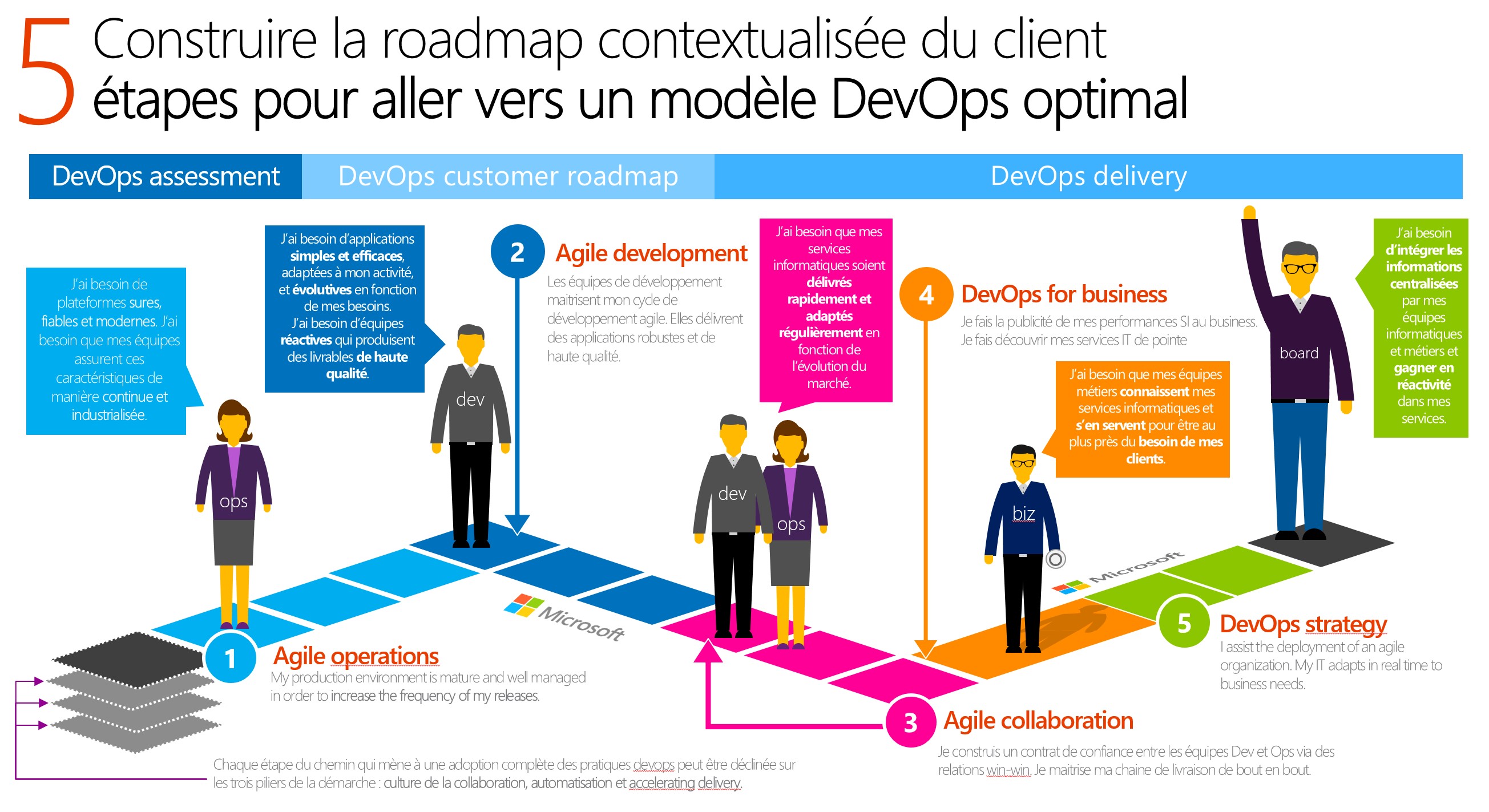

Par ailleurs, l'adoption d'une démarche « DevOps » ne se fait pas nécessairement en une seule fois, elle peut être progressive en fonction des priorités de chaque entreprise. La progressivité dans l'adoption des différentes pratiques permet aussi l'établissement d'une culture de collaboration entre les « Devs » et les « Ops ».

La première étape est un état des lieux de la situation, puis de construire une feuille de route contextualisée permettant une adoption progressive des capacités DevOps.

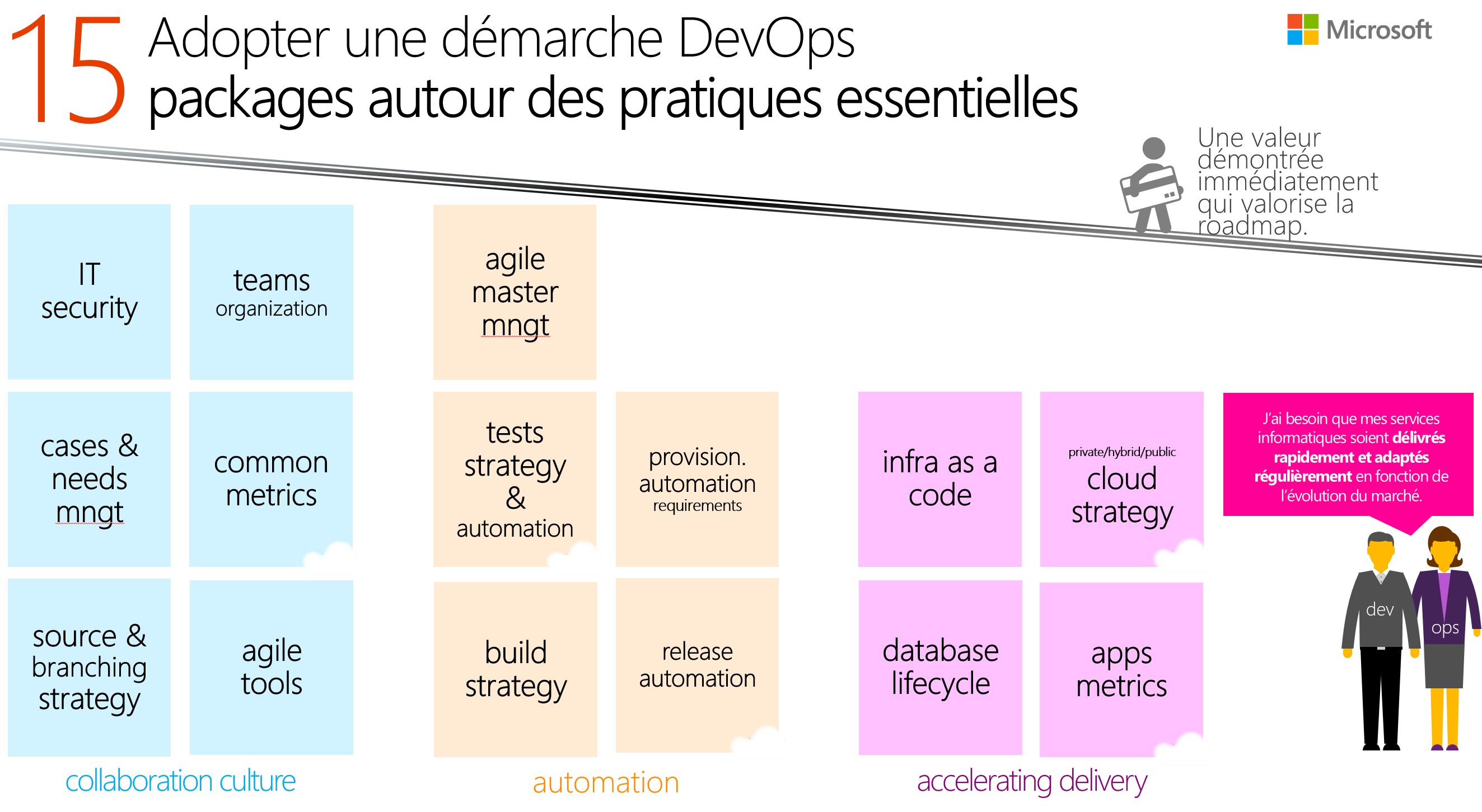

Voici quelques exemples de packages qui font partie des scénarios de transformation DevOps :

Nous allons nous focaliser sur certaines briques de la démarche.

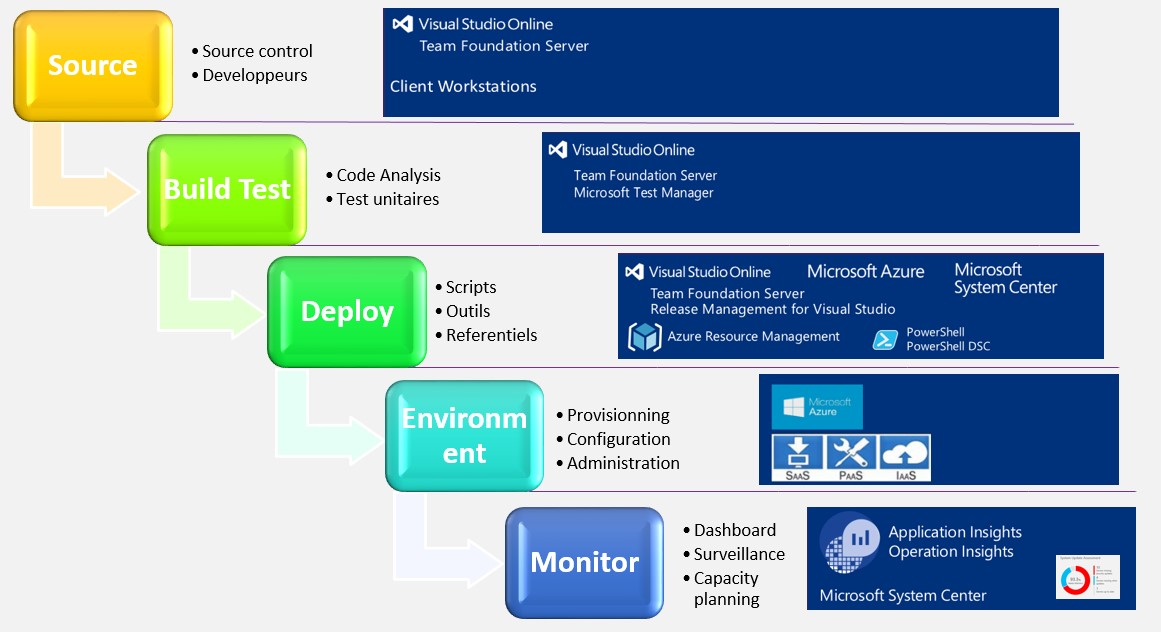

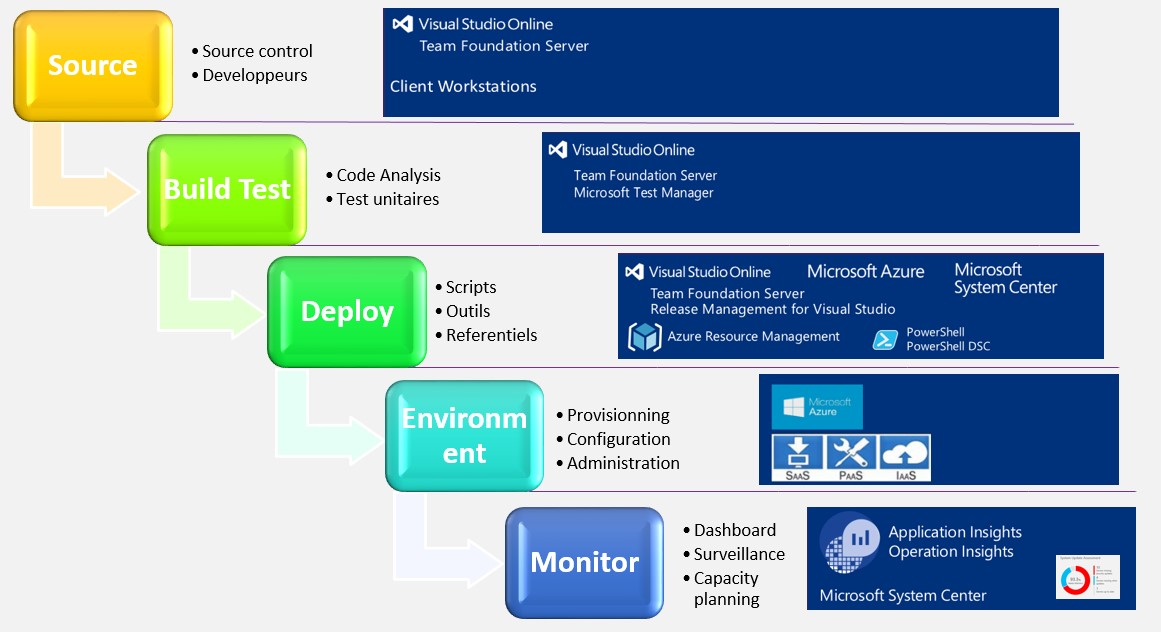

Les briques clés avec l'écosystème Microsoft

Les différentes briques nécessaires au développement, test, support d'une application avec les produits, les technologies facilitatrices.

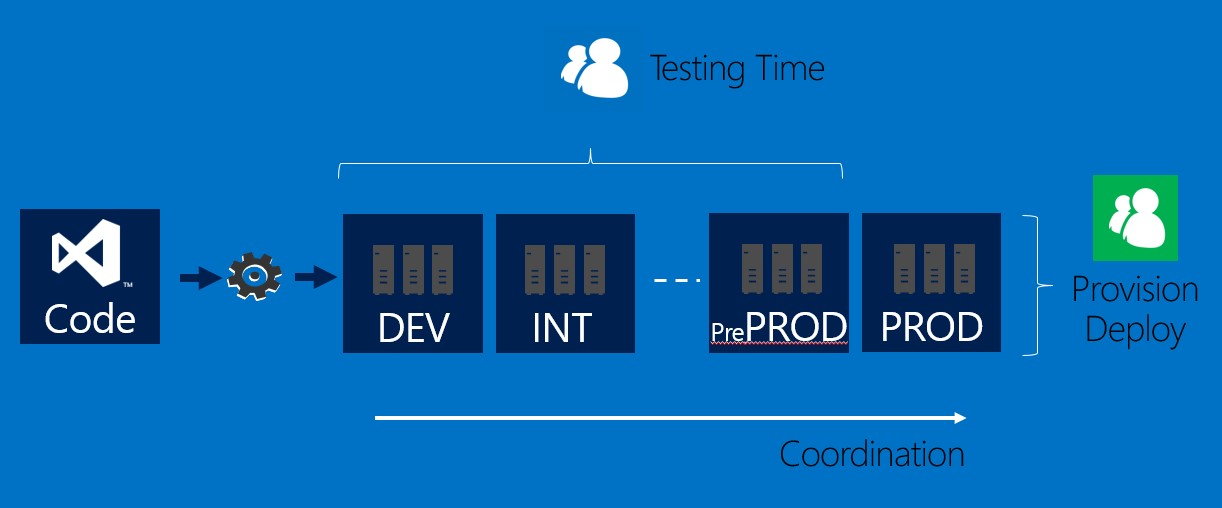

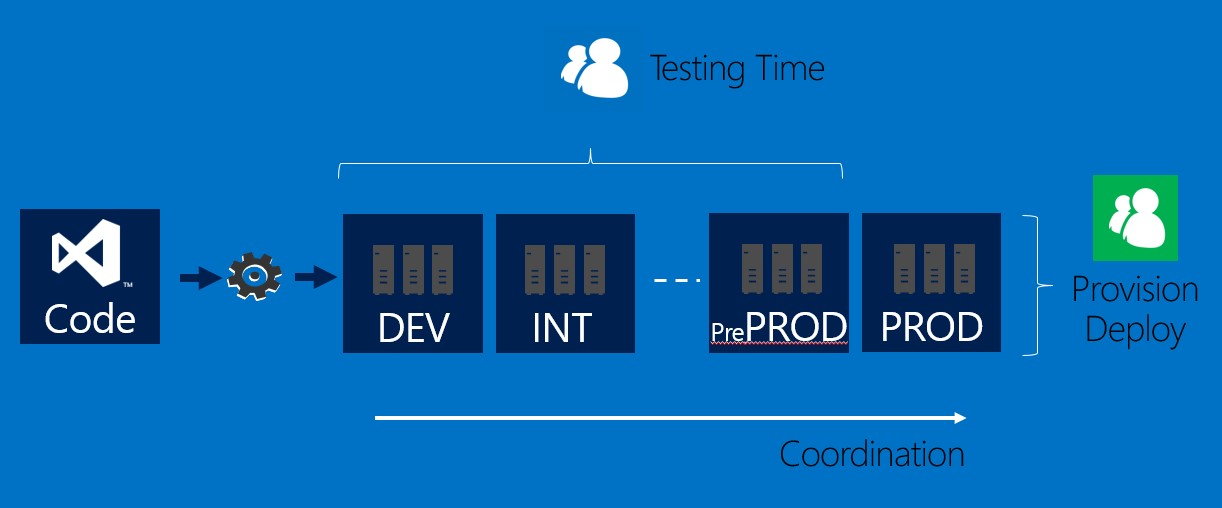

Le cycle de vie d'une application est complexe et nécessite de nombreux environnements qui peuvent être couteux de par leur immobilisation et administration :

Afin d'orchestrer les différents étapes d'un processus de release, Team Foundation Server propose aussi un outil de gestion de releases (Release Management) qui permet la gestion du déploiement au travers des différents environnements.

L'infrastructure nécessaire

La mise à disposition des différents environnements et des services nécessite généralement plusieurs semaines et ce avec des coûts de maintenance, d'investissements. Afin d'augmenter la réactivité et limiter les coûts le cloud Azure est la solution :

- Libre-service, à la demande

- Ubiquité : accès au cloud depuis n'importe où

- Facturation à la consommation

- Mise à disposition de plateforme en quelques heures

- Mise à disposition à la demande de service SaaS accessible de partout : réactivité

Visual Studio Online peut être pris en exemple: le projet dispose alors d'un service de source control ainsi que l'ensemble des outils ALM (gestion du cycle de vie des applications) sans aucune gestion de l'infrastructure

- Evolution d'un profil de dépense d'investissement CAPEX vers un profil de dépense de fonctionnement OPEX

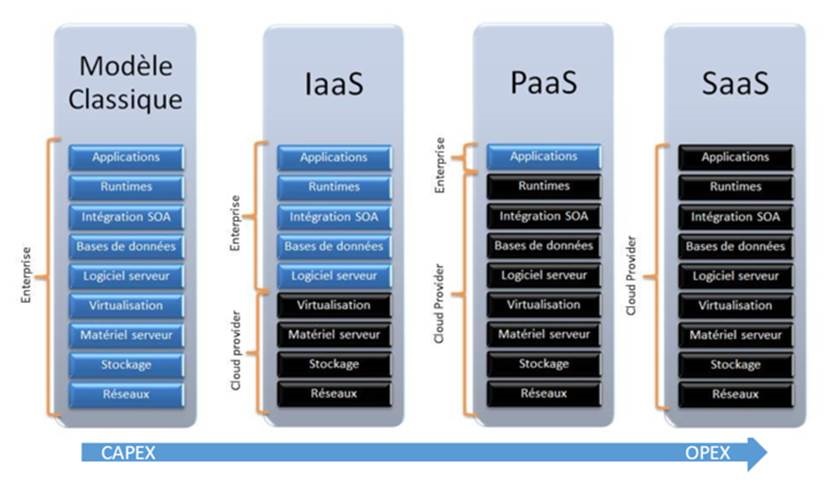

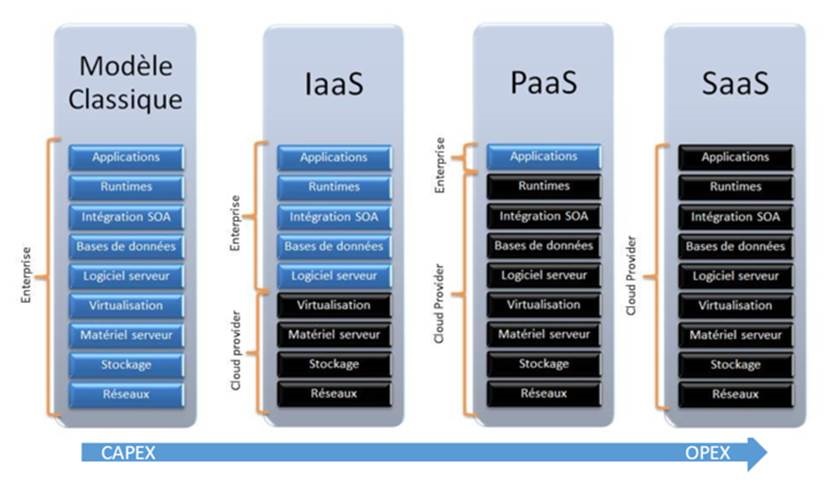

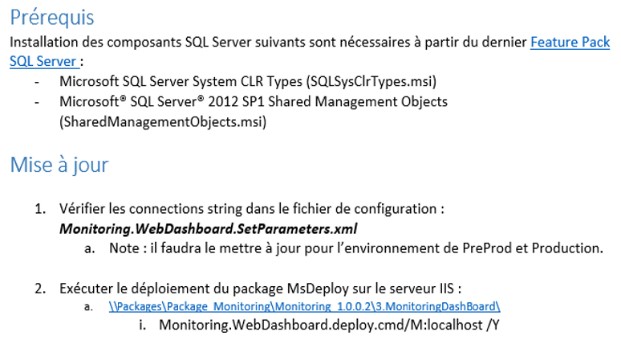

Windows Azure permet d'accélérer cette transition en proposant les modèles suivants : IaaS (Infrastructure as a Service), PaaS (Plateforme as a Service), Saas (Software as a Service) qui permettent un investissement décroissant.

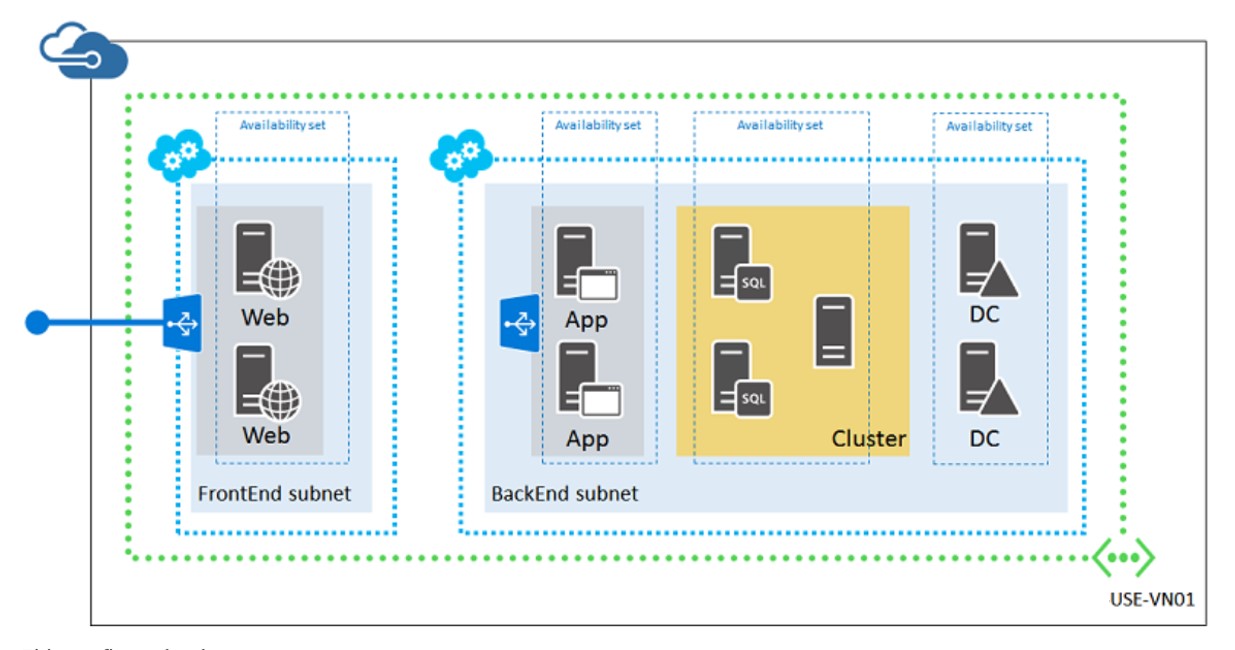

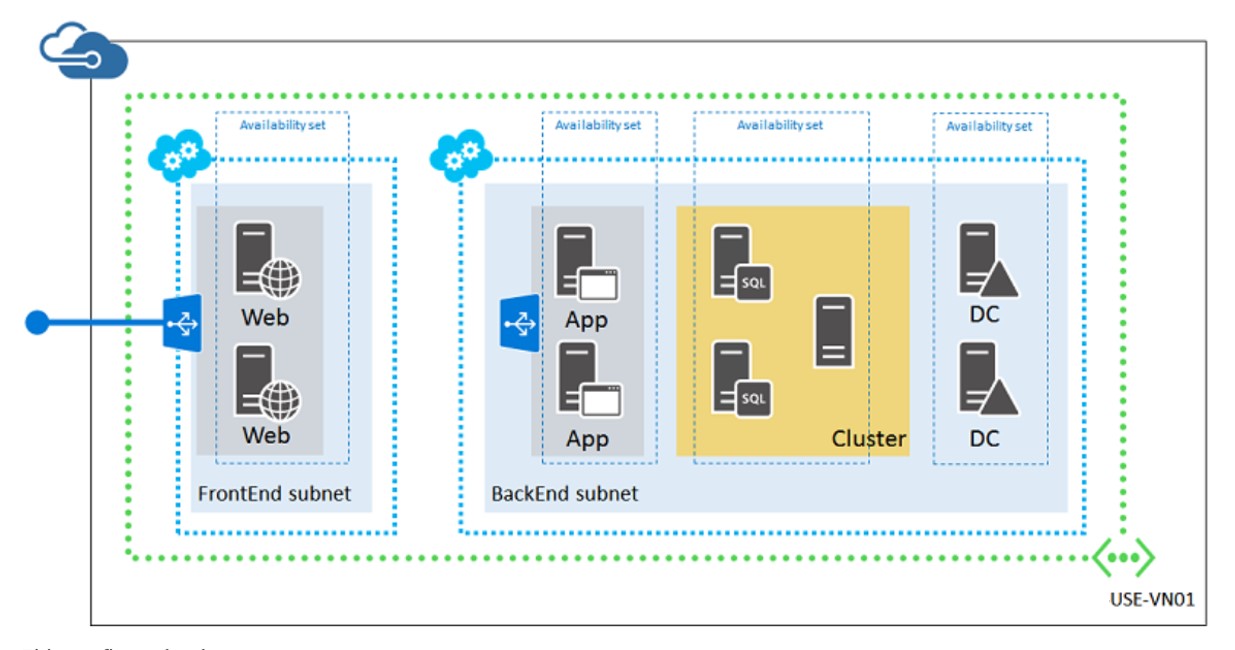

Une infrastructure applicative se compose généralement de plusieurs serveurs afin de répartir les différents rôles : serveurs applicatifs, serveurs de données, serveurs d'annuaires avec des contraintes de haute disponibilité.

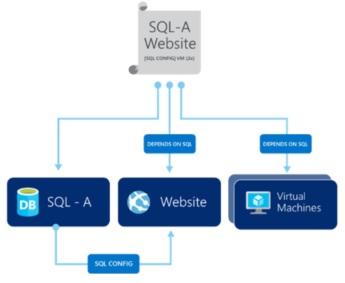

Voici une architecture applicative classique :

L'objectif est de simplifier le déploiement et la configuration de ce type de plateforme en utilisant les fonctionnalités de Microsoft Azure, ainsi que les dernières technologies.

Automatisation : Déploiement et configuration d'une infrastructure

Les outils, technologies à disposition :

Azure Ressource Management (ARM)

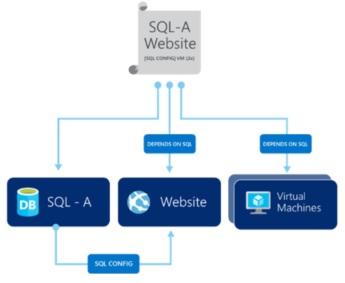

Habituellement les applications sont constituées de plusieurs composants, ressources : applications web, bases de données, serveurs de bases de données, stockage, services tiers, … Ils sont interdépendants.

Azure Resource Manager vous permet de travailler avec les ressources de votre application en tant que groupe afin de pouvoir les déployer, mettre à jour au sein d'une opération unique et coordonnée.

Un modèle de déploiement décrivant tous les composants, ressources, ainsi que leurs dépendances pourra être utilisé pour fonctionner avec l'ensemble des environnements : développement, recette,… et production.

Ce modèle se décrit sous la forme d'un document au format Json définissant l'ensemble des ressources. Le modèle se personnalisera avec des paramètres d'entrées afin de s'adapter aux différents environnements.

Afin de couvrir les besoins d'opérations supplémentaires, comme l'installation et la configuration d'un logiciel spécifique, des extensions peuvent être utilisées pour accéder à des services de configuration tels que Powershell DSC, Chef ou Puppet.

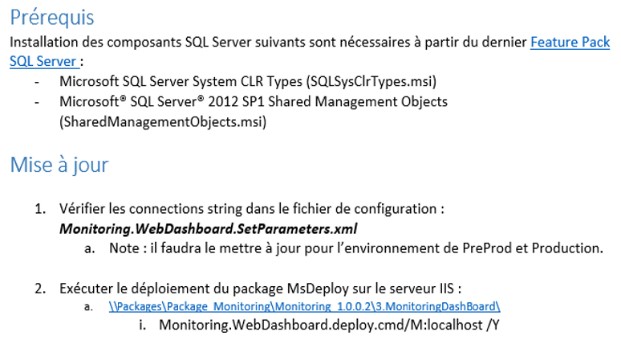

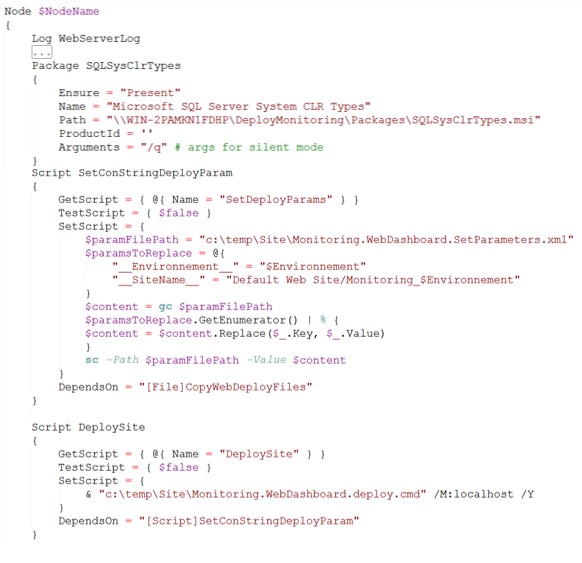

Powershell Desired State Configuration (DSC)

Windows PowerShell Desired State Configuration (DSC) est un système de gestion inclus dans Windows PowerShell qui permet le déploiement et la gestion des données de configuration.

L'objectif est de définir une configuration cible et ainsi d'atteindre un état désiré sans se soucier de l'état initial. Il s'agit d'un besoin indispensable notamment lors de « déploiements en continue », on doit pouvoir exécuter plusieurs fois le même script de configuration.

L'évolution est donc la suivante afin d'éviter toute erreur et d'automatiser la procédure de déploiement:

Procédure de déploiement habituelle et manuelle

Procédure de déploiement avec Powershell DSC

Evolutivité de l'infrastructure : Ressources systèmes, Stockage, ...

Un des premiers besoins est de permettre l'évolutivité d'une infrastructure pour des besoins ponctuels ou permanents avec des délais de mise à disposition très courts:

- Besoins de ressources systèmes supplémentaires : Processeurs, Mémoire, Capacité IOPS, …

Les ressources peuvent être affectées, désaffectées en quelques minutes. Les configurations de serveurs virtuels vont d'une configuration minimale avec 0,25 cœur – 750 Mo RAM à 32 cœurs – 448 Go RAM – 64 disques SSD avec du stockage Premium.

Il est très rapide de provisionner du stockage, pour le stockage standard que le volume réellement utilisé est facturé : jusqu'à 1 To par disque -> 500 To par Compte de stockage (Défaut) -> 100 Storage Account par Abonnement (Défaut)

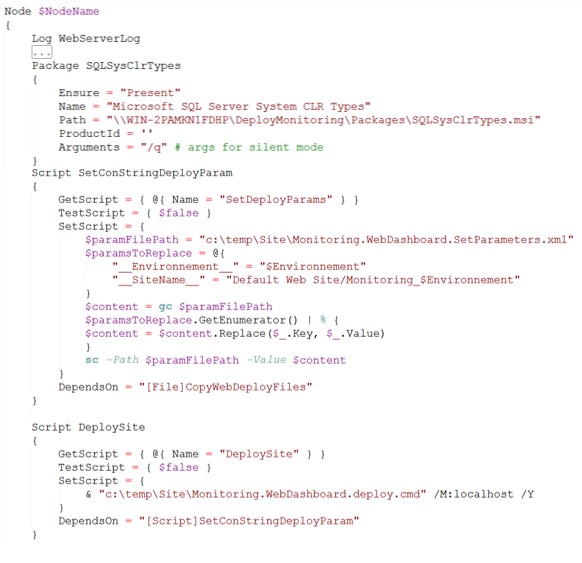

Pour des besoins spécifiques de type base de données notamment avec SQL Server, la performance du sous-système disque est vitale et souvent la cause de la dégradation des temps de réponses sur les environnements de développement et de tests de charge qui ne sont pas à la hauteur de l'environnement de production.

On pourra donc homogénéiser les performances de chaque environnement à moindre coût, ponctuellement en utilisant les ressources Azure.

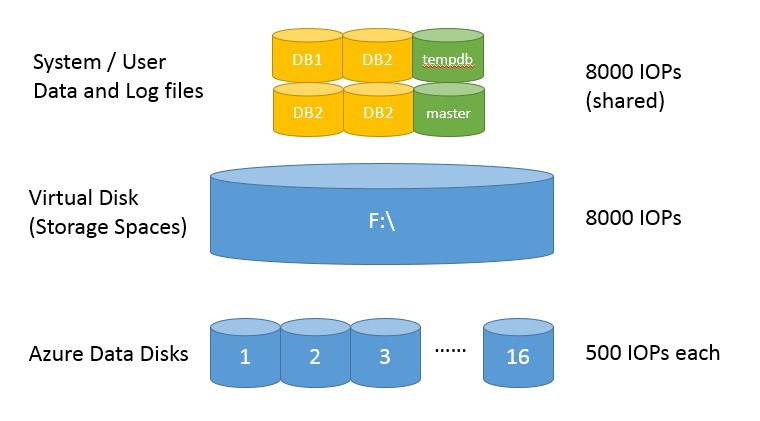

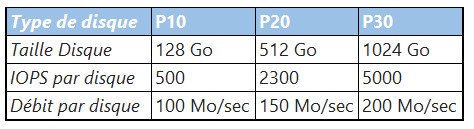

Les performances du sous-système disque sont en corrélation avec la puissance de la machine allouée, ainsi que du type de stockage choisi :

Par disque : 500 IOPS max, débit 60 Mo/s max, taille jusqu'à 1 To

Par machine virtuelle : de 1 à 32 disques possibles

Il se décline sous 3 types de disque

Par machine virtuelle : de 1 à 32 disques possibles

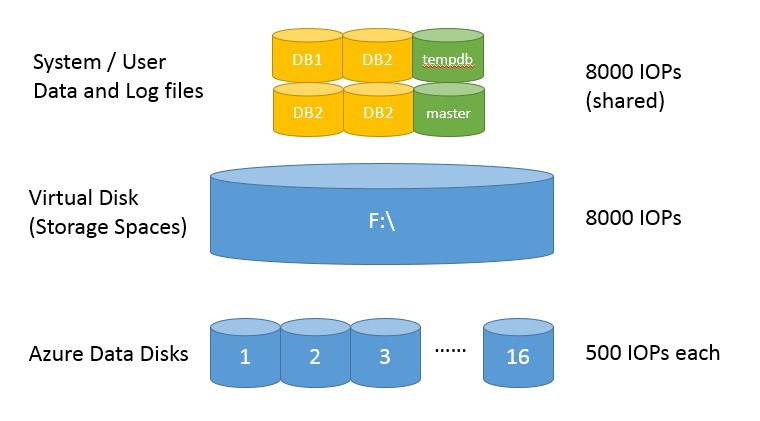

Afin de simplifier la configuration et de bénéficier du maximum d'IOPS, l'agrégation de plusieurs disques Azure est souhaitable. Grâce à la fonctionnalité Storage Pool de Windows Server 2012, la création d'un seul disque logique s'appuyant sur l'ensemble des disques disponibles permettra d'obtenir le maximum des performances et de simplifier l'administration.

Cette configuration permettra d'avoir un socle générique par exemple pour SQL Server qu'il faudra ensuite adapter en fonction des spécificités.

Exemple de configuration avec 16 disques Azure standards:

En agrégeant 16 disques, nous pouvons obtenir jusqu'à 8000 IOPS

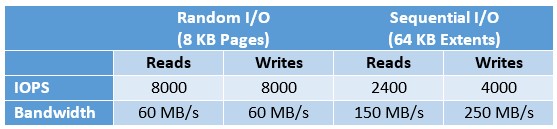

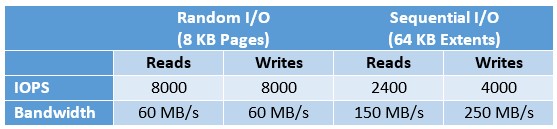

Quelques résultats de tests montrant les performances de ce type de configuration:

Si ce niveau de performance est insuffisant, il suffira de provisionner plus de disques avec une machine virtuelle de gamme supérieure et / ou passer en Storage Premium afin de pouvoir atteindre jusqu'à 50 000 IOPS. Cette flexibilité permettra d'évaluer à moindre coût la configuration de la plateforme cible.

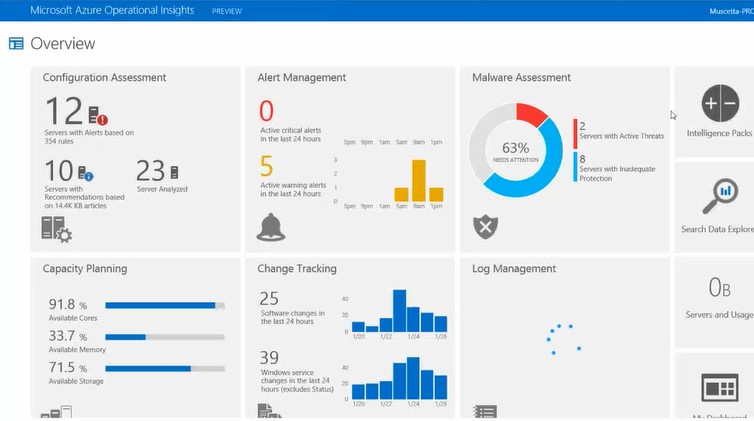

Administration, Gestion d'infrastructure

Une fois la plateforme configurée, il est indispensable de l'administrer et de la maintenir avec une infrastructure de supervision. Elle permettra de consolider l'ensemble des évènements : Journaux d'évènements, compteurs de performance, définition d'alertes, …

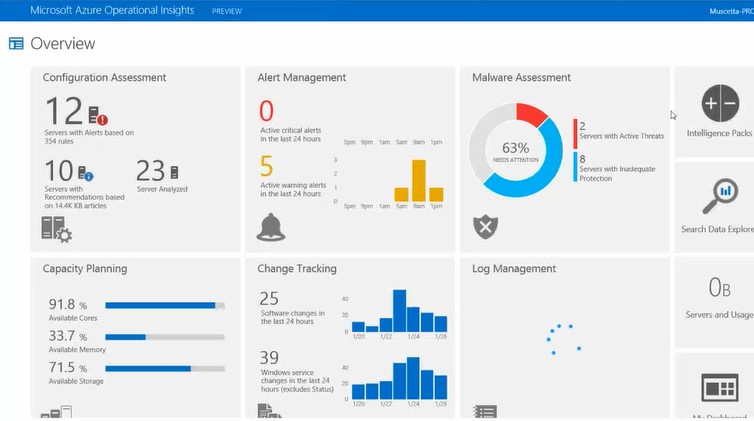

Ces besoins apparaissent dès le début du projet où les efforts sont généralement mis sur les développements en délaissant la supervision. Pour cela, Azure met nativement à disposition des agents de supervision, ainsi que les services Operational Insights et Application Insights afin de piloter votre infrastructure et votre application.

De nombreuses fonctionnalités:

- Surveillance de l'usage coté client

- Capacity planning

- Consolidation d'évènements

- Mise en place d'alertes

- Validation de configuration « Assessment » en fonction de bonnes pratiques

- Mise à disposition de tableaux de bord

Synthèse

La plateforme Cloud de Microsoft, Windows Azure met à disposition les services et les infrastructures indispensables pour répondre aux contraintes actuelles du marché et accompagner les entreprises dans leur transformation : réduction des couts, amélioration de la réactivité (Time to market), proximité des clients, …

L'ensemble des produits et services Azure sont concernés :

- Microsoft Azure

- Microsoft Azure IaaS

- Visual Studio Online

- Operational Insight,s Application Insights

- …

Des solutions innovantes avec Microsoft Consulting Services

Les architectes et consultants MCS sont formés sur l'ensemble de l'offre applicative et infrastructure de Microsoft, afin de proposer à leurs clients des solutions innovantes permettant de répondre à leurs enjeux opérationnels, et de s'engager dans une démarche de transformation numérique.

Pour plus d'informations sur les offres packagées Microsoft Consulting Services, rendez-vous sur https://www.microsoft.com/france/services. Nous vous invitons à y consulter notamment les diverses offres CRM et Business Analytics proposées.

Pour plus d'informations sur les blogs « L'innovation par les données », rendez-vous sur L'innovation par les données .

| Richard Prade, Consultante CRM, Microsoft Consulting Services Après plusieurs années passées au support technique, j'interviens en mission de conseil auprès des grands comptes sur des projets à haute criticité s'appuyant sur la suite SQL Server : architecture, gestion de cycle de vie applicatif, optimisations, … |

| João Bôrras, Consultant Senior, Microsoft Consulting Services Je suis consultant chez Microsoft Consulting Services depuis plusieurs années et je suis spécialisé dans le développement d'applications en particulier dans le domaine de la finance. Plus récemment j'accompagne les clients dans la transformation de leurs solutions vers des architectures cloud et la gestion du cycle de vie des applications (ALM/DevOps) |

L'innovation par les données – Introduction

L'équipe Data Insight de Microsoft Consulting Servicescomposée d'experts reconnus de la plateforme de gestion des données, autour de SQL Server et Microsoft Business Intelligence (MSBI), vous propose une nouvelle série de billets concernant la mise en œuvre de solutions innovantes, à travers des focus sur des cas métiers concrets et des exemples d'implémentation en réponse à un besoin fonctionnel.

Dans la continuité de la précédente série « SQL Server chez les clients » que vous pouvez retrouver sur le blog de l'équipe SQL Server France (https://blogs.technet.com/b/sql/archive/tags/sql+chez+les+clients) cette nouvelle série de billets proposée par Microsoft Consulting Services vous permettra de comprendre comment les entreprises peuvent tirer de la valeur à partir de leurs données opérationnelles et/ou de données publiques (Open Data, Réseaux Sociaux) afin de les transformer en information stratégique, et ce, sous différents prismes : le décisionnel d'entreprise, le décisionnel en libre-service, l'apprentissage par les données (Machine Learning, Predictive Analysis), le traitement de données semi ou non structurées…

La série d'articles L'innovation par les données abordera un large spectre de thématiques métiers, pouvant reposer sur l'ensemble de la proposition de valeur de Microsoft, et notamment :

- SQL Server 2014

- Power BI

- Azure ML

- SQL Azure

- HD Insight

- SharePoint

- Dynamics

- Yammer

L'équipe Data Insight Microsoft Consulting Services

L'équipe Data Insight de MCS, l'entité conseil de Microsoft, est composée de consultants et d'architectes experts et certifiés (notamment Microsoft Certified Master, SSAS Maestro et Hadoop), qui accompagnent au quotidien leurs clients dans la mise en œuvre de solutions innovantes, traitant de la donnée, afin de répondre à leurs enjeux métiers.

Les consultants et architectes de l'équipe Data Insight sont avant tout des passionnés qui mettent leur expertise au service de leurs clients, en apportant une réelle valeur ajoutée notamment grâce à leurs nombreux retours d'expérience, ainsi qu'une relation étroite avec les autres équipes de Microsoft (Produits, Support…).

Cette équipe est composée de : Antoine Richet, Christian François, Frédéric Bonnot, Frédéric Gisbert, Hervé Marie, Jérémy Samama, Jordan Doulle, Jérome Coquidé, Marc Minéo, Mathias Ekizian, Mickael Bouskila, Omar Battoum, Richard Prade, Sihame Aarab, Sophie Bismuth, Sébastien Grosbois ainsi que Xiaozhao Li, et dirigée parPascal Belaud.

Pour plus d'informations sur les offres Microsoft Consulting Services, rendez-vous sur : https://www.microsoft.com/france/services

L'innovation par les données - Le marketing direct

La conquête de nouveaux clients constitue un facteur clé dans toutes les entreprises commerciales. La transformation d'un simple prospect en client représente un coût important, il est donc essentiel de disposer de processus performants et maitrisés.

Problématique

- Mesurer l'efficacité d'une campagne de marketing

- Valider le coût d'acquisition d'un nouveau client

- Transformer des prospects en clients

Bénéfices

- Un coût de mise en œuvre maitrisé

- Une solution évolutive

- Agilité et partage de la solution

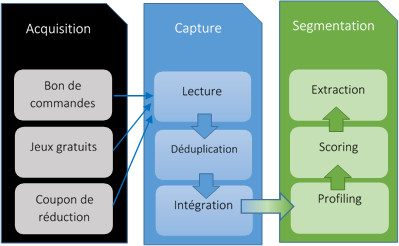

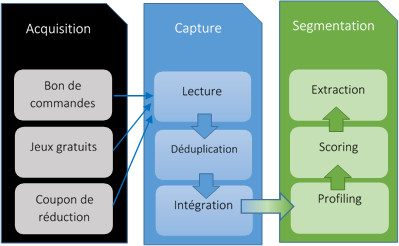

Le marketing direct : Capture des réponses et analyse du profil des clients

Lors d'une campagne de marketing direct, l'une des principales phases concerne le ciblage d'un profil de client. Il est d'ailleurs habituel de comparer ce ciblage avec un groupe témoin sélectionné aléatoirement sur la base de données marketing. En effet, cette approche permet de valider la pertinence du ciblage.

Une fois la campagne exécutée un ensemble de nouvelles informations peuvent être disponibles :

-

- Un bon de réponse accompagnant l'offre, avec idéalement des informations complémentaires

-

- Un coupon de réduction en caisse, permettant au passage d'identifier le magasin de prédilection d'un client

-

- Un jeu gratuit accompagné d'un questionnaire

-

- Ou tout simplement les retours avec les NPAI (n'habite plus à l'adresse indiquée)

La capacité d'une équipe marketing à définir de manière plus précise le profil des clients concernés, et à définir avec la plus grande justesse un nouveau ciblage permet de diminuer le coût d'acquisitions de nouveaux clients en augmentant le ROI de l'opération.

Il est donc essentiel de comprendre et de segmenter les clients que nous souhaitons contacter. Etendre une gamme de produit chez un client captif nécessite d'identifier les principales relations que la société entretient avec ce client, il peut s'agir :

- D'un client fidèle depuis longtemps

- D'un acheteur occasionnel

- D'un premier achat

- D'un client à la recherche d'une information

- …

Par conséquent, chaque profil nécessite une série d'actions distinctes et adaptées au contexte spécifique de la personne ciblée.

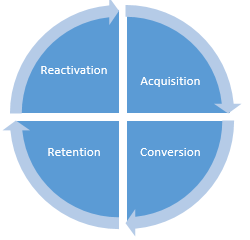

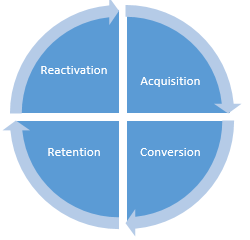

Le cycle classique de gestion de la relation client est composé de 4 grandes étapes, et chacune nécessitant une action spécifique :

Présentation de la solution

La solution présentée dans cet article a pour objectif de fournir, aux équipes marketing, les informations nécessaires pour :

Normaliser et dé-dupliquer les adresses

Enrichir une base existante

Définir un profil des clients de la campagne

Appliquer ce nouveau profil à des clients jamais contactés auparavant

Cette solution se décompose en deux grandes étapes :

Dans l'exemple ci-dessous, nous pouvons visualiser les différentes formes que peuvent prendre les adresses remontées par les campagnes marketing :

Adresses | Commentaires |

Danny L Gutierrez 758, avenue du Québec 75003 Paris France | Adresse de référence dans la base de données de marketing |

Danny L Gutierrez 758 av du Québec Paris 3e France | Le rapprochement des adresses doit passer par une phase de normalisation. Il va s'agir de transcrire les adresses sous un format unique - Av = Avenue, ou BLV, Blvd, bl = Boulevard, …

- De respecter les normes postales (4 champs sur 32 positions pour les adresses, un code postal sur 5, …)

|

Dany L Goutierze 758 av du Québec Paris 3e France | Nous avons ici plusieurs erreurs au niveau du nom du contact : - Des lettres manquantes Dany au lieu de Danny

- Des inversions de lettres Goutierze au lieu de Gutierrez

Deux approches complémentaires sont envisageables pour traiter ces problématiques : la phonétisation et/ou la recherche en logique flou. |

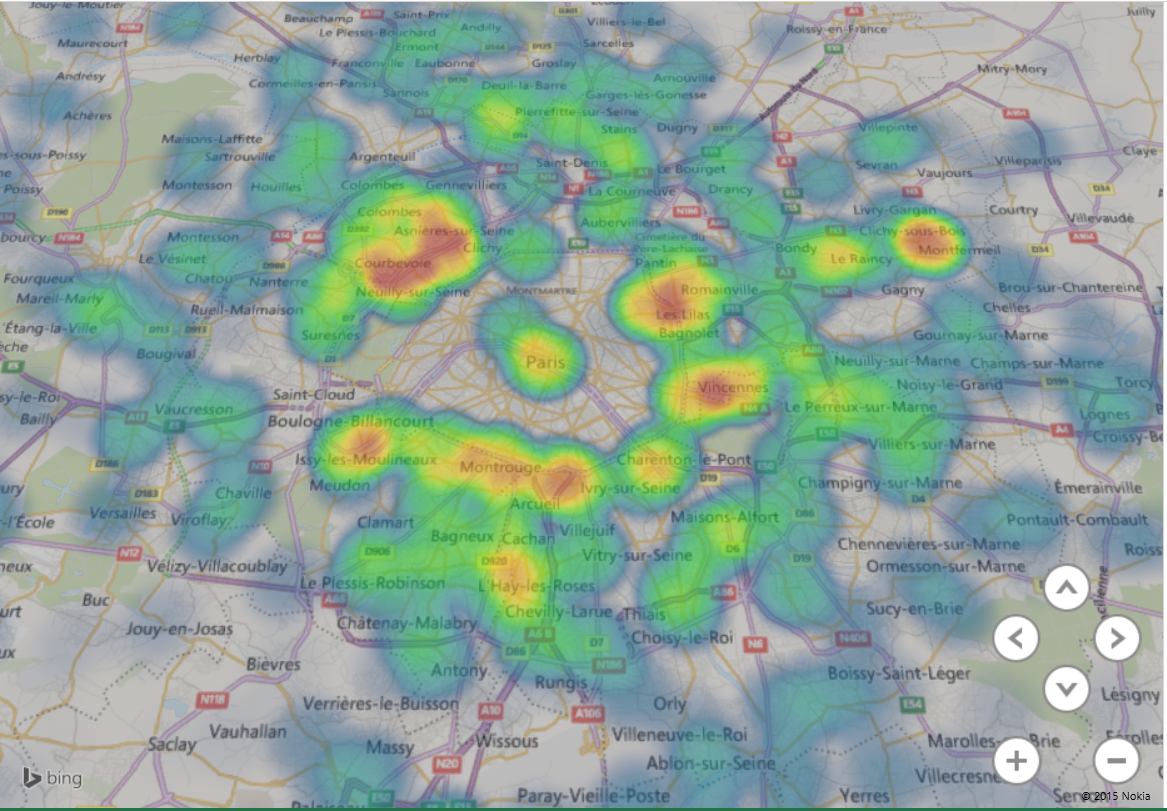

Une fois que les données en entrée sont normalisée, et dé-dupliquées avec notre base de données marketing, nous allons pouvoir non seulement enrichir la base avec de nouvelles informations, mais en plus récupérer les données socio démographiques à notre disposition.

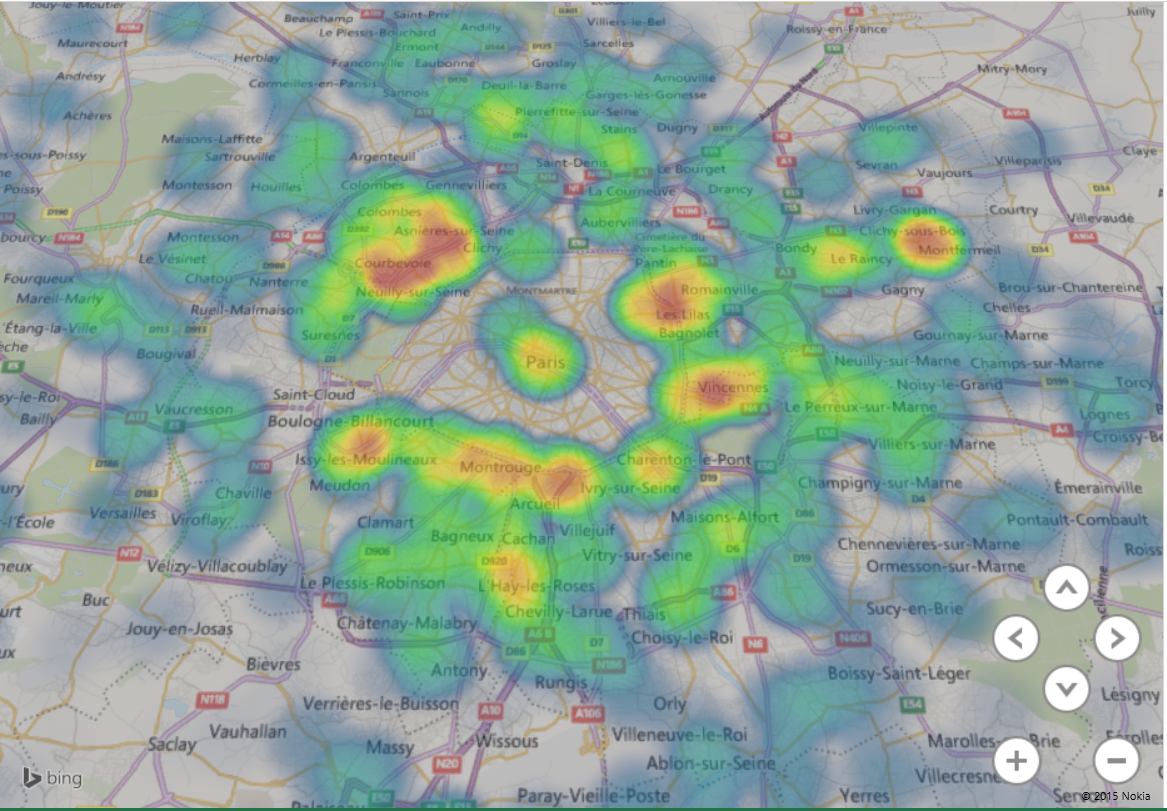

Cependant, à l'issue d'une campagne, la première question qui se pose, est de connaitre le taux de réussite de l'opération. Il est habituel lors de la construction d'une campagne marketing de contacter deux populations distinctes, la première n'est pas ciblée et correspond à une sélection aléatoire, et la seconde qui répond à des critères très précis. Une fois l'ensemble des adresses nettoyées, il est très simple de comparer les 2 cibles sur une carte à l'aide de Power Map.

Il est d'ailleurs possible d'intégrer des informations provenant directement des instituts de sondages et de les visualiser sur une carte, ou encore de construire une analyse complète à l'aide Power Pivot. Avec la suite Power BI, les équipes métiers peuvent en toute autonomie, analyser et intégrer toutes les informations à leurs dispositions

En parallèle les équipes de statisticiens peuvent construire un nouveau modèle de segmentation, avec des données propres et validées.

Cette segmentation permettra de toucher une nouvelle population, que nous n'avions pas contactée lors de notre première campagne, mais très proche de celle ayant réagi positivement à notre offre.

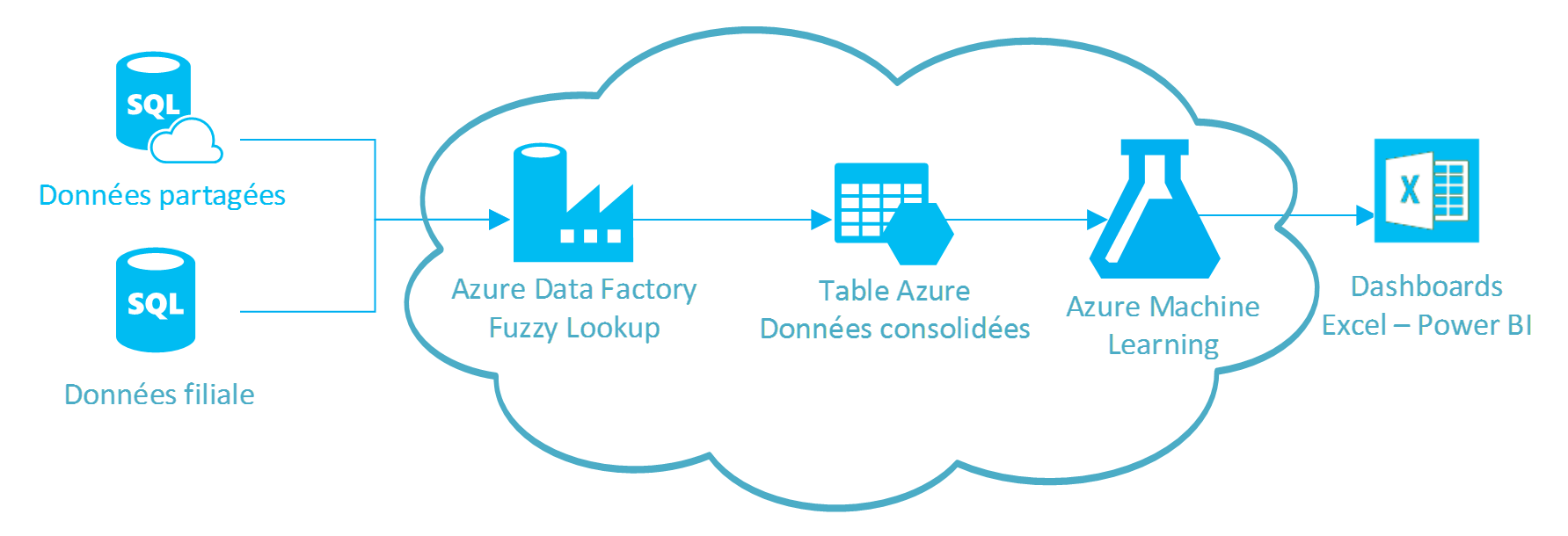

Architecture de la solution

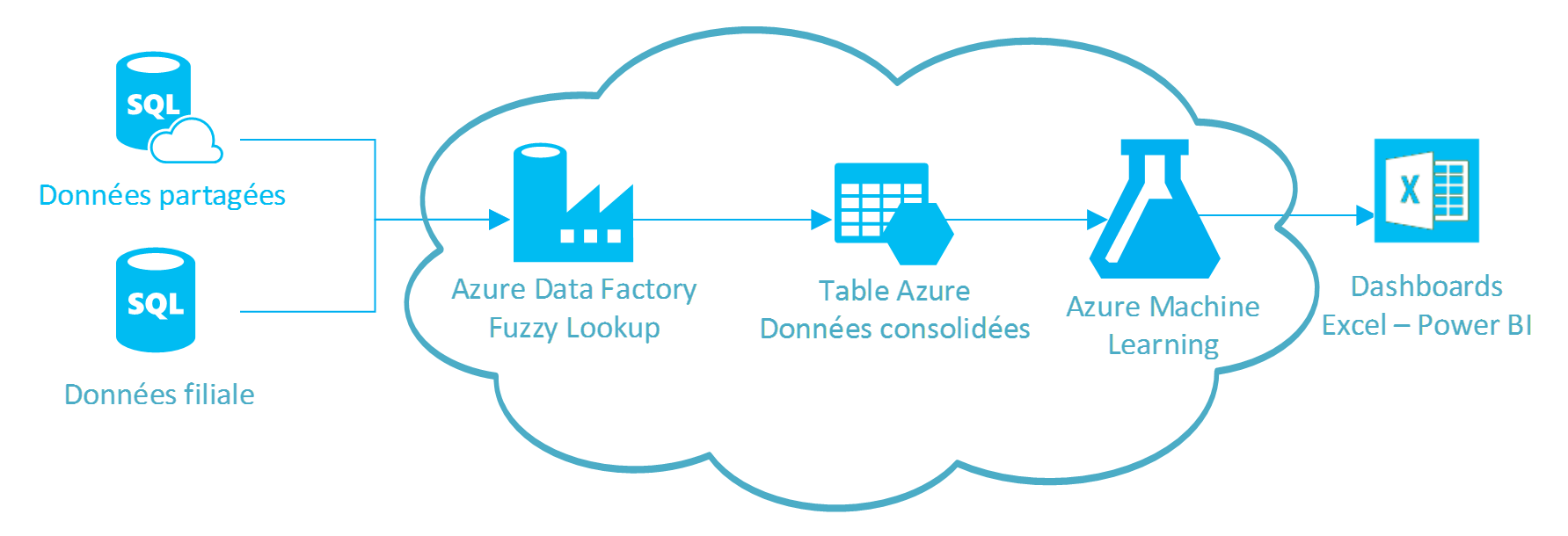

La solution décrite précédemment est architecturée de la manière suivante :

Les informations sont collectées à l'aide d'un ETL, en l'occurrence Azure Data Factory

Lors du chargement les composants de Fuzzy Look Up et de Look up sont utilisés afin de rapprocher les données avec la base existante. Si l'ETL sélectionné est Azure Data Factory, alors nous utiliserons une fonction de phonétisation classique. Il reste possible d'intégrer des composants tiers dans ce mécanisme de rapprochement des données

La segmentation et l'application du modèle s'appuient sur une solution dans le cloud utilisant les méthodes de Machine Learning appelée Azure Machine Learning

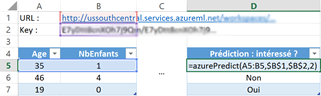

Ce modèle est partagé en mettant à disposition un web service, ce qui permet d'interconnecter Excel, ou tout autre outil et ainsi de qualifier en temps réel une demande (par exemple dans le cas d'un call center)

L'architecture présentée ici est hybride : une partie des données spécifiques à la filiale est dans une base de données SQL Server classique, une autre partie des données accessibles à toute l'entreprise est stockée dans une base de données Azure SQL géo-répliquée dans le cloud.

Une approche de cloud hybride permet de profiter des avantages du cloud (Machine Learning, élasticité, géo-réplication, disaster recovery, etc…) par-dessus une architecture physique déjà existante.

De plus, Azure Machine Learning permet de concevoir un modèle prédictif et le partager sous forme de web service.

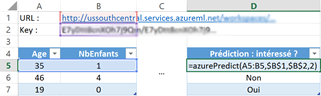

Ce web service, identifié par une adresse URL et une clé d'authentification, peut alors être appelé depuis n'importe quel fichier Excel à l'aide d'une simple fonction :

Synthèse

Cet article a illustré la manière de procéder à une étude de marketing direct, d'un point de vue fonctionnel et technique

Produits concernés :

- SQL Server 2014

- SQL Azure

- Azure Data Factory

- Azure Storage (Blog, Table)

- Azure Machine Learning

- Excel - Power BI

Des solutions innovantes avec Microsoft Consulting Services

Les architectes et consultants MCS sont formés sur l'ensemble de l'offre applicative et infrastructure de Microsoft, afin de proposer à leurs clients des solutions innovantes permettant de répondre à leurs enjeux opérationnels, et de s'engager dans une démarche de transformation numérique.

Pour plus d'informations sur les offres packagées Microsoft Consulting Services, rendez-vous sur https://www.microsoft.com/france/services

Plus d'informations sur les blogs « L'innovation par les données ».

Mickael Bouskila, Consultant Senior BI/SQL, Microsoft Consulting Services J'interviens dans le cadre de projets décisionnels chez des clients, en tant que leader technique, et également en assistance pour une validation d'architecture, de l'audit, ou une optimisation de solutions basées sur la gamme de produits Microsoft Business Intelligence. Je suis spécialisé dans les problématiques de modélisations, en MDX et DAX, ainsi que sur des périmètres fonctionnels allant de la grande distribution, au marketing direct en passant par le milieu bancaire. |

Jérémy Samama, Consultant Data Insights, Microsoft Consulting Services Issu du Graduate Program de Microsoft (MACH), j'interviens sur des missions d'analyse de données, principalement en BI, BIG DATA et Machine Learning . |

L'innovation par les données – Le pilotage commercial B2C

Cet article a pour objectif de présenter une solution de pilotage en temps réel d'une activité commerciale B2C (Business to Consumer), qui démontre la valeur ajoutée et l'agilité que peuvent offrir aux entreprises les architectures basées sur le Cloud et les équipements mobiles connectés.

Problématique

- Fournir aux directions commerciales les indicateurs nécessaires au pilotage de l'activité.

- Disposer d'informations sur la typologie des visiteurs dans les boutiques.

- Pouvoir être notifié en cas de déclenchement d'une règle métier en fonction de la situation.

Bénéfices

- Une solution adaptée aux besoins opérationnels de l'organisation.

- L'agilité et l'élasticité du Cloud au service de l'entreprise.

- La capacité des équipes en mobilité à rester connectées avec l'activité commerciale.

Le pilotage commercial dans le monde du retail

Les activités de commerce grand public sont particulièrement concernées par les questions de pilotage en temps réel de l'activité, notamment pour des besoins de réactivité et de prise de décision rapide, afin d'ajuster une stratégie par rapport à une situation donnée.

En phase de définition d'une stratégie commerciale, les équipes managériales doivent tenir compte d'un certain nombre de paramètres :

- Le profil du consommateur (tranche d'âge, sexe, CSP…)

- Les habitudes de consommation (pause-déjeuner en semaine, soirée, week-end…)

- Les canaux d'achat (centre commerciaux, boutiques en centre-ville, internet…)

La capacité d'une direction commerciale à comprendre le profil et les habitudes de ses clients potentiels constitue un réel avantage concurrentiel dans la mesure où cela permet d'ajuster un certain nombre de leviers :

- L'ajustement de l'offre commerciale

- La gestion des achats et du stock

- Le pilotage des forces de ventes

Le fait de pouvoir travailler sur des données les plus fraiches possibles, reflétant l'image d'une situation immédiate, permet de prendre très rapidement des décisions, afin d'ajuster une stratégie par rapport à une situation réelle.

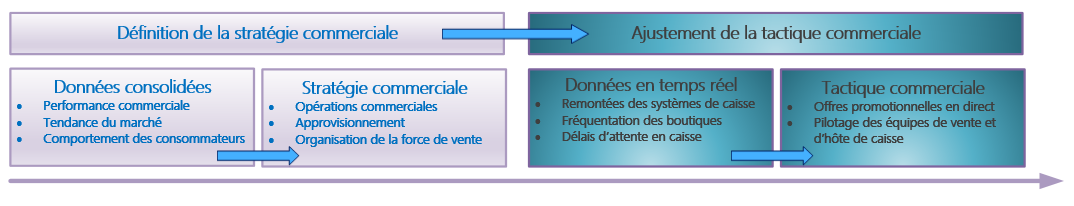

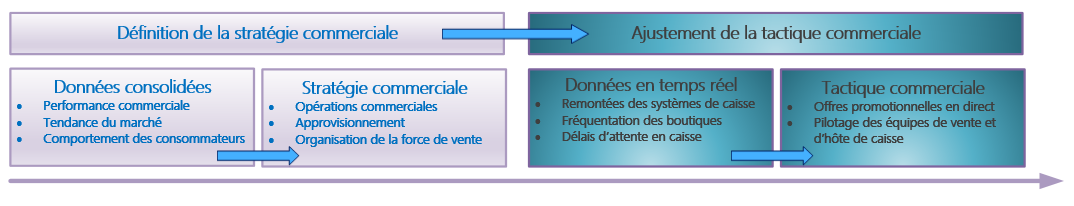

Présentation de la solution

La solution présentée dans cet article a pour objectif de fournir, aux équipes managériales de vente, les informations nécessaires pour :

- Définir une stratégie commerciale sur la base d'informations consolidées

- Ajuster de manière tactique cette stratégie à partir d'informations opérationnelles remontées en temps réel

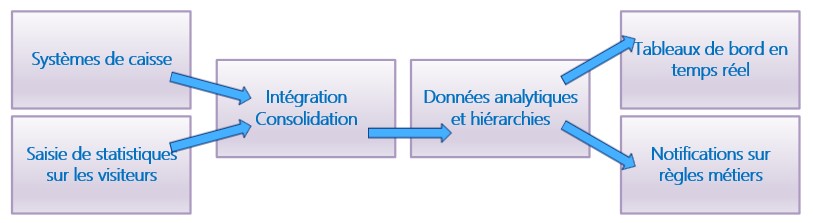

Cette solution s'articule principalement autour de deux sources de données :

- Les informations remontées par les systèmes de caisse, permettant d'obtenir les chiffres des données de vente, avec le détail de chaque ticket de caisse (produits, quantités, promotions, numéro de client…)

- Les informations sur les flux de visiteurs entrant dans les boutiques, avec la typologie de ces clients potentiels

- Visiteurs individuels, féminins ou masculins

- Groupes de visiteurs, féminins, masculins, couples

- Familles…

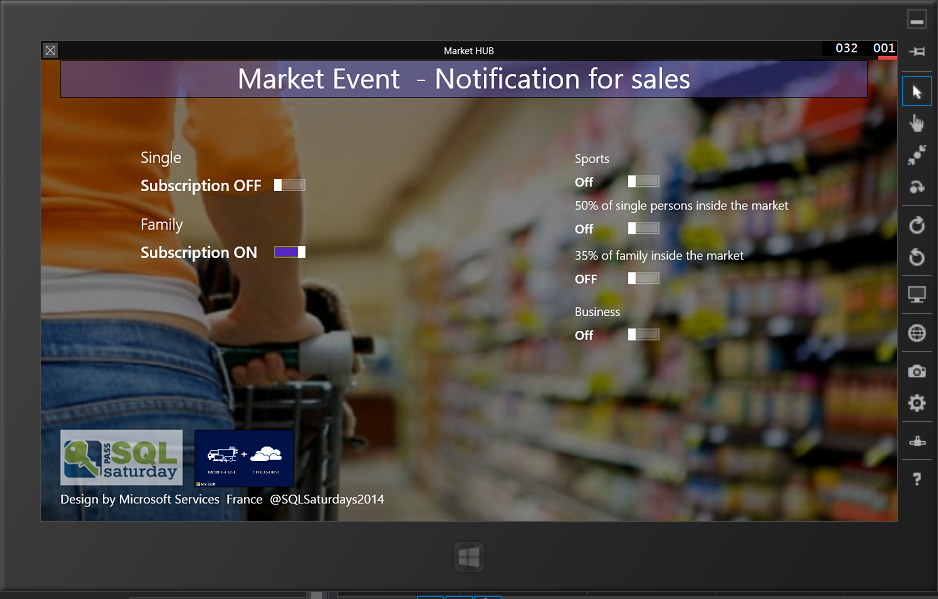

Dans l'exemple ci-dessous, l'application déployée sur un téléphone mobile permet de saisir instantanément tout type de visiteur qui entre dans la surface de la boutique :

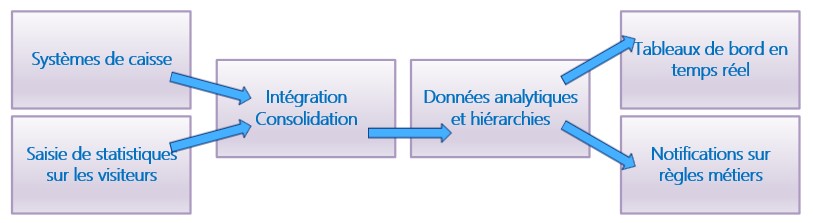

Ces deux sources d'information sont directement intégrées dans un système de consolidation de données, sous la forme de magasins de données métiers et d'analyse (« Datamart »), avec au passage l'application de mécanismes d'enrichissement des données :

- Informations issues du catalogue produit

- Informations issues du système CRM (logiciel de gestion de la relation client)

Une fois consolidées, ces informations servent de sources de données pour l'alimentation de bases d'analyse, exposant une vue métier et hiérarchique des données permettant de fournir une palette d'information en temps réel sur l'activité commerciale :

- Le chiffre d'affaire, la performance des différents rayons

- L'efficacité des opérations commerciales

- Le taux de transformation des visiteurs en acheteurs

- La typologie des visiteurs actuellement présents dans les boutiques

- Les possibles ruptures de stock

- ….

Ces bases d'analyses sont utilisées pour répondre à des requêtes générées par des tableaux de bord utilisés par l'équipe managériale, qui offrent une vue à 360° de l'activité de l'enseigne.

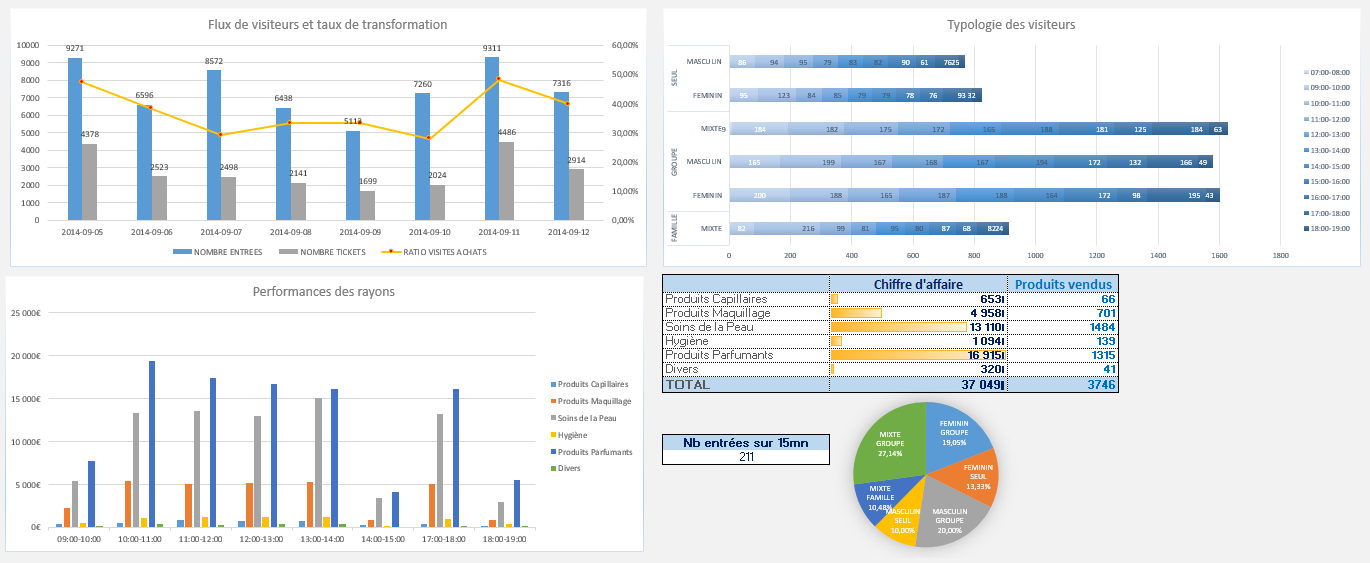

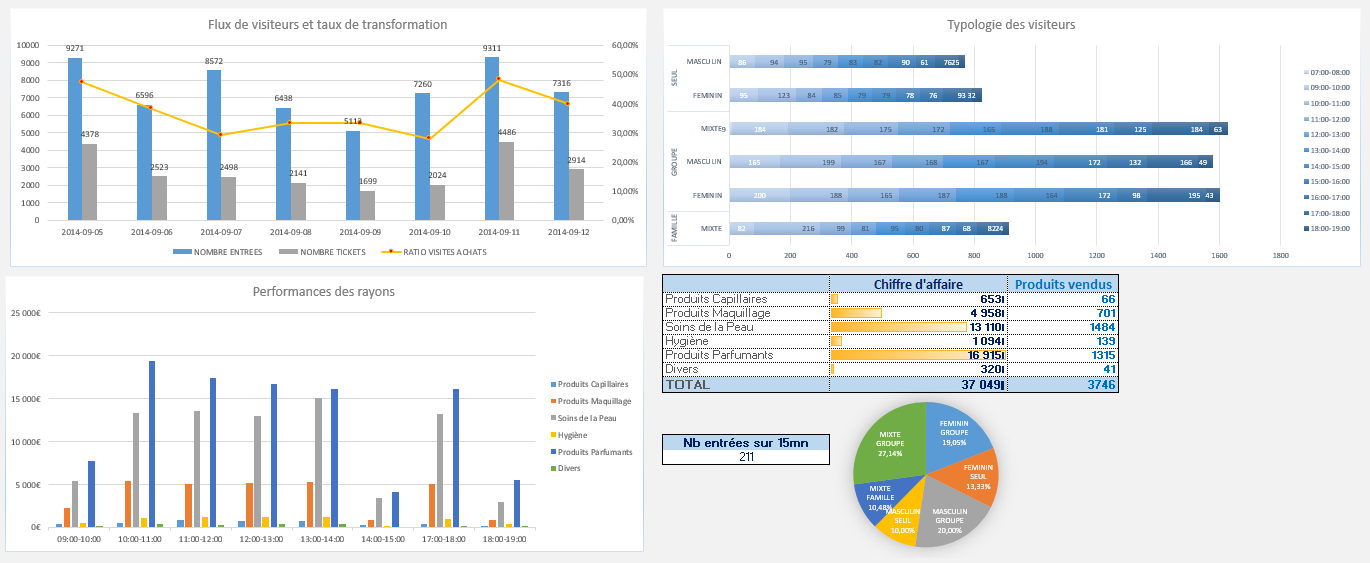

Dans le tableau de bord présenté en exemple ci-dessous, les informations suivantes sont présentées :

- Le nombre de visiteurs, le nombre de tickets de caisse, le taux de transformation

- Le chiffre d'affaire et le nombre de produits vendus par rayons

- L'évolution de la performance des différents rayons, par tranche horaire

- La typologie des visiteurs en fonction de la tranche horaire

- Le nombre et la typologie des visiteurs entrés dans la boutique sur les 15 dernières minutes

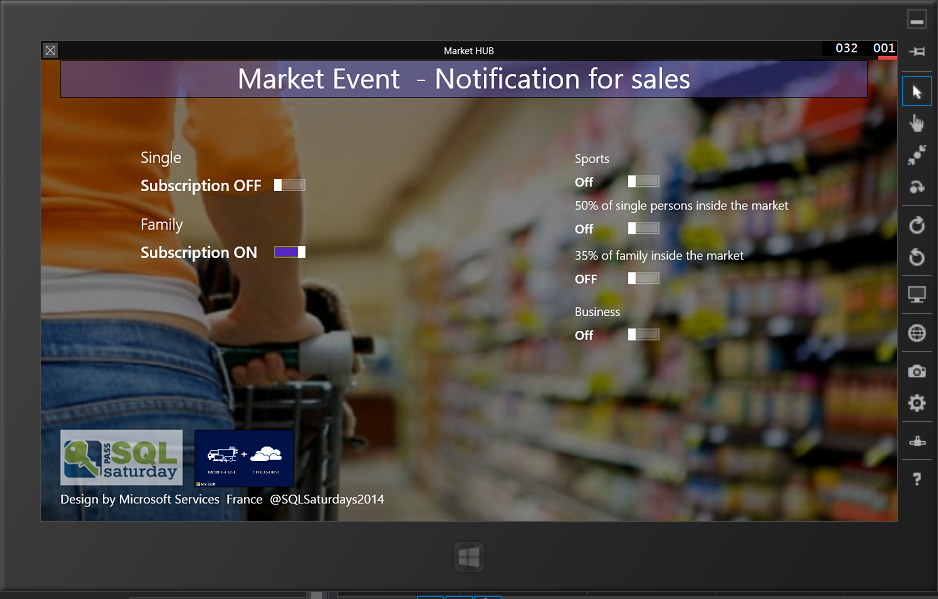

Les indicateurs implémentés dans les bases d'analyse sont également utilisés en tant que support pour des notifications auxquelles sont abonnés les membres de l'équipe managériale, afin d'être alertés en temps réel lorsque la situation coïncide avec un des seuils définis parmi les règles métiers.

Ce type d'application moderne, implémentée dans un équipement mobile tel qu'une tablette, donne la possibilité aux décideurs d'être informés, à tout moment, d'un évènement particulier qui peut avoir un impact sur l'activité, et qui peut nécessiter l'activation de leviers spécifiques.

L'application pour tablette Windows 8 présentée ci-dessous permet de s'abonner à des règles, et d'être notifié en temps réel lorsque la situation coïncide avec cette règle :

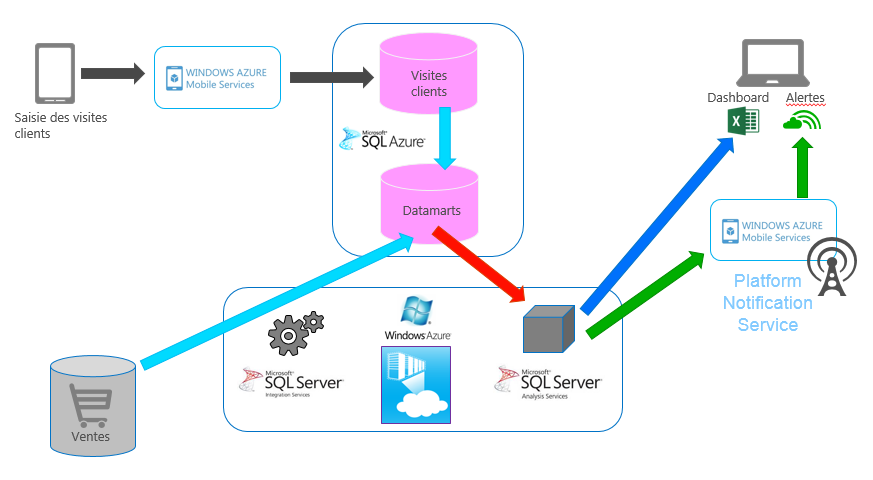

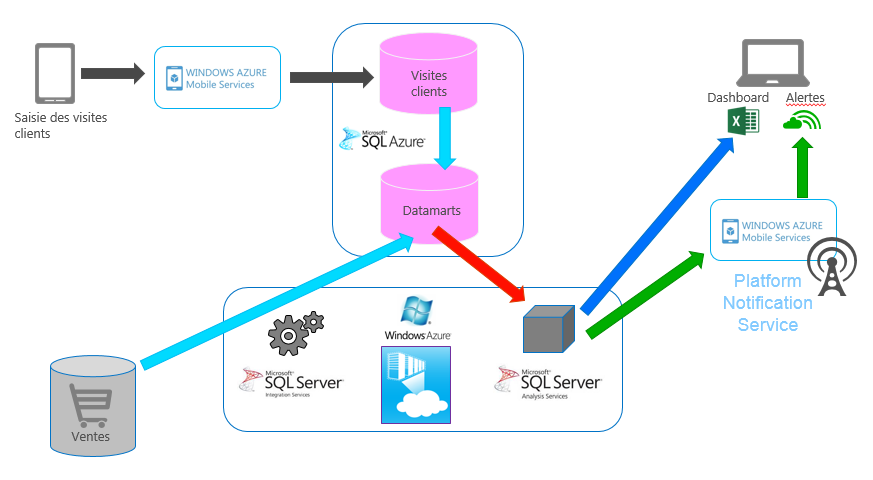

Architecture de la solution

La solution décrite précédemment est architecturée de la manière suivante :

- Les informations sur les visiteurs des boutiques sont collectées à partir d'une application déployée sur des téléphones mobiles, et connectée à une instance de service de la plateforme Windows Azure Mobile Services à laquelle est adossée une base de données Cloud SQL Azure.

- Des magasins de données métier (Datamart) sont implémentés dans des bases de données Cloud SQL Azure (PAAS : Platform As A Service), et alimentés à partir de programmes d'intégration de données (ETL), SQL Server Integration Services, utilisés pour collecter, traiter et intégrer des données issues :

- Des systèmes de caisses déployés dans les boutiques

- De la base de données de saisie des visiteurs

- Une couche d'analyse, basée sur SQL Server Analysis Services, est implémentée dans une infrastructure virtualisée Windows Azure Virtual Machine (IAAS : Infrastructure As A Service), et configurée pour tenir compte en temps réel des données chargées dans le Datamart.

- Des tableaux de bord, basés sur Office 2013 Power BI, qui consomment les statistiques et indicateurs exposés par la couche d'analyse, sont rafraîchis automatiquement.

- Un système de notifications, sous la forme d'une application moderne déployée sur un équipement mobile, et basée sur Windows Azure Mobile Services et Windows Azure Notification Hub pour recevoir les alertes.

Cette solution est architecturée autour d'une collection de services Cloud de Microsoft Windows Azure, afin de proposer des fonctionnalités pouvant être rapidement mises en œuvre et déployées, capable de monter en charge, et de s'adapter aux contraintes des équipes en mobilité.

D'autre part, ce type d'architecture gérée dans le cloud, permet de réduire les couts :

- CAPEX pour les infrastructures virtualisées Windows Azure Virtual Machine

- CAPEX et OPEX pour les plateformes de données SQL Azure Database

A noter également que les solutions de back office Cloud pour équipement mobile Windows Azure Mobile Services, fournissent les API nécessaires pour concevoir et déployer rapidement des solutions pour équipements mobiles (Windows Phone, iOS…) et ce à partir de différents langages (C#, Javascript), tout en offrant l'élasticité nécessaire pour absorber les périodes d'importante montée en charge.

Synthèse

Cet article a présenté une solution s'appuyant sur les nombreuses possibilités de la plateforme Cloud de Microsoft, Windows Azure, afin de proposer aux directions commerciales une solution de pilotage de l'activité , basée sur des tableaux de bord temps réel et sur un système de notifications.

Produits concernés :

- SQL Server 2014

- SQL Azure

- Windows Azure Virtual Machine

- Windows Azure Mobile Service

- Windows Azure Notification Hub

- Modern Apps

- Power BI

Des solutions innovantes avec Microsoft Consulting Services

Les architectes et consultants MCS sont formés sur l'ensemble de l'offre applicative et infrastructure de Microsoft, afin de proposer à leurs clients des solutions innovantes permettant de répondre à leurs enjeux opérationnels, et de s'engager dans une démarche de transformation numérique.

Pour plus d'informations sur les offres packagées Microsoft Consulting Services, rendez-vous sur https://www.microsoft.com/france/services

Plus d'informations sur les blogs « L'innovation par les données ».

| Mathias Ekizian, Consultant Data Insight, Microsoft Consulting Services J'interviens dans le cadre de projets décisionnels chez des clients, en tant que leader technique, et également en assistance pour une validation d'architecture, de l'audit, ou une optimisation de solutions basées sur la gamme de produits Microsoft Business Intelligence. Je suis également spécialisé dans les problématiques de gestion des données d'entreprise (Enterprise Information Management). |

| Frédéric Gisbert, Architecte Data Insight, Microsoft Consulting Services J' interviens en clientèle sur des problématique BI, Big Data et plus globalement de gestion de données (MDM, CEP, SharePoint) en tant que lead technique et architecte. Le but premier d'un architecte solution est d'intégrer la suite SQL Server dans des environnements hétérogènes en considérant toutes les spécificités de chacun de nos clients. J'interviens aussi dans des problématiques Big Data sur nos solutions Hortonworks (Hadoop) Certification :Analysis Services MAESTRO |

L'innovation par les données – Le pilotage des moyens autoroutiers

Cet article a pour objectif de présenter une solution de pilotage en temps réel du trafic autoroutier en se basant sur les données des péages et ainsi fournir un certain nombre de statistiques :

- Nombre de véhicules,

- catégories de véhicule,

- charge du réseau, etc.

Ces métriques permettent d'ajuster si nécessaire les structures inhérentes sur les autoroutes comme le nombre de guichets ouverts (automatiques ou pas), d'engager ou non des ressources sur le terrain (agents autoroutiers, gendarmerie (contrôles), etc..), régulation de la vitesse, véhicules d'interventions supplémentaires, etc..

Croisées à des données météo, à des prévisions de trafic saisonnier, une évaluation des risques est possible et permet les ajustements humains et matériels.

Problématique

Fournir aux responsables de gestion du trafic les indicateurs nécessaires au pilotage de l'activité

Disposer d'informations sur la typologie du trafic

Pouvoir être notifié en cas de déclenchement d'événements exceptionnels en fonction de la situation

Bénéfices

Une solution adaptée aux besoins opérationnels permettant plus de sécurité des usagers

Une optimisation financière en mettant en adéquation ressources et réalité terrain

La capacité des équipes en mobilité à rester connectées avec le pilotage opérationnel.

Le pilotage opérationnel

Le trafic autoroutier, de plus en plus important, nécessite un pilotage en temps réel, notamment pour des besoins de réactivé et de prise de décision permettant d'ajuster, entre autres, les ressources engagées sur le terrain.

Les paramètres suivants peuvent être pris en compte :

Le profil des véhicules (Véhicules de tourisme, camping-car, autocars, poids lourds)

Les habitudes de circulation (départ en semaine, soirée, week-end, etc.)

Les conditions météos

Les cas « spéciaux » comme les départs en vacances chassés croisés, week-end prolongé, etc..

La capacité d'une équipe opérationnelle à comprendre sur la durée le profil des véhicules, les habitudes de ses usagers, les conséquences liées à la météo, l'impact des cas spéciaux constitue un réel avantage d'anticipation dans la mesure où cela permet d'ajuster un certain nombre de leviers :

Agents autoroutiers, notamment sur la gestion des péages pour fluidifier les passages

Gendarmerie qui permet d'apporter une surveillance passive améliorant la sécurité

Régulation de la vitesse permettant de diminuer le risque de bouchons

Véhicules d'interventions supplémentaires pour la prise en charge rapide d'un incident ou d'un accident.

L'ensemble de ces informations et leviers permettent in fine une augmentation de la sécurité sur les autoroutes en apportant les ressources humaines et matérielles adéquates.

Le fait de pouvoir travailler sur les données les plus fraiches possibles, reflétant l'image d'une situation immédiate, permet de prendre très rapidement des décisions, afin d'ajuster une stratégie par rapport à une situation réelle.

Présentation de la solution

La solution présentée dans cet article a pour objectif de fournir, aux équipes managériales, les informations nécessaires pour :

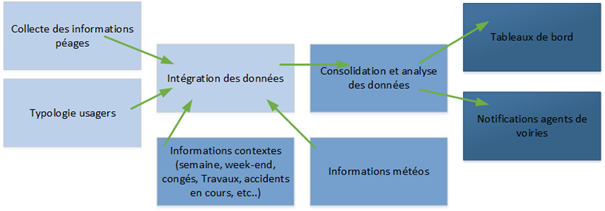

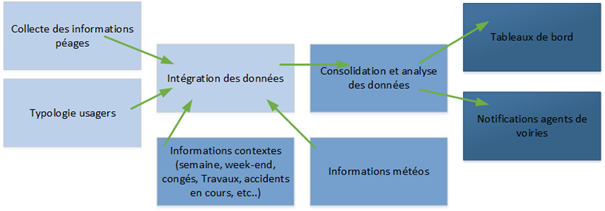

Cette solution s'articule principalement autour de deux sources de données (opérées par des capteurs avec du matériel spécifique) :

La capture des informations en provenance des péages permettant à la fois de quantifier le nombre de véhicules mais aussi leurs types (voiture, camion, deux-roues, etc.)

La capture des informations sur les usagers accédant à l'autoroute afin d'estimer le nombre et le genre des personnes :

Ces deux sources d'information sont consolidées, traitées et injectées sous forme de magasins de données métiers et d'analyse (« Datamart ») avec au passage l'application de mécanismes d'enrichissement des données :

Informations issues de la météo

Informations issues d'autres systèmes on-premise permettant d'intégrer à l'analyse des informations de contexte lié à des situations particulières comme les congés, des travaux, des incidents/accidents déjà en cours, etc..

Ces informations servent alors de sources pour l'alimentation des bases d'analyse, exposant une vue métier et hiérarchique des données permettant de fournir une palette d'information en temps réel sur le trafic :

Ces bases d'analyses sont utilisées pour répondre à des requêtes générées par des tableaux de bord utilisés aussi bien par les équipes qui suivent et analysent l'évolution du trafic, mais aussi par les agents de terrain qui peuvent anticiper des situations.

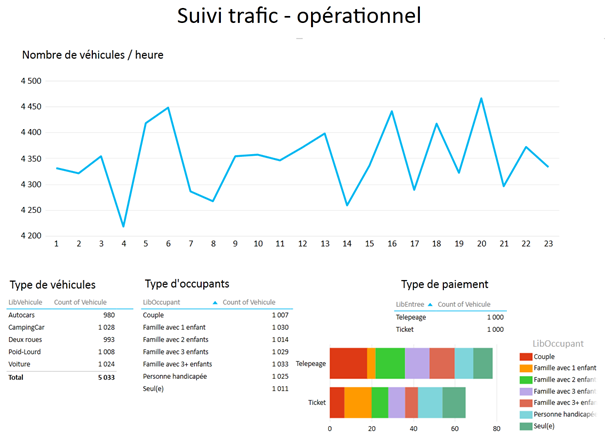

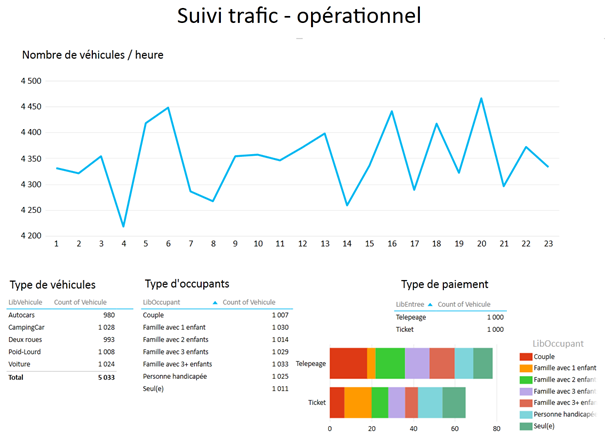

Dans le tableau de bord en exemple ci-dessous, les informations suivantes sont présentées :

Le nombre de véhicules sur le réseau, heure par heure sur une journée

Le profil des véhicules

L'estimation et le profil des usagers

Les indicateurs implémentés dans les bases d'analyse sont également utilisés en tant que support pour des rapports spécifiques pour les agents de terrain, ce qui permet d'être informé en temps réel de l'évolution du trafic, tout en définissant des seuils métiers en fonction de la topologie de la journée par ex (week-end, congés, jour de semaine, etc.)

L'intérêt du système réside dans le besoin d'anticiper au mieux le flux des automobilistes afin de principalement :

Architecture de la solution

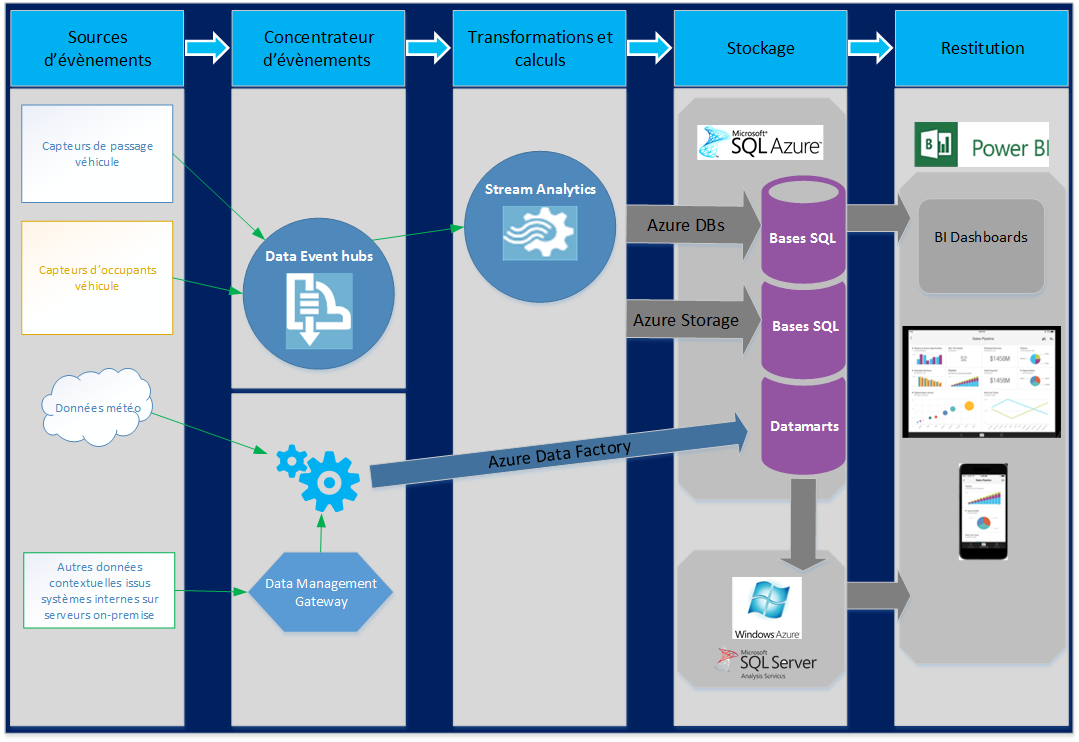

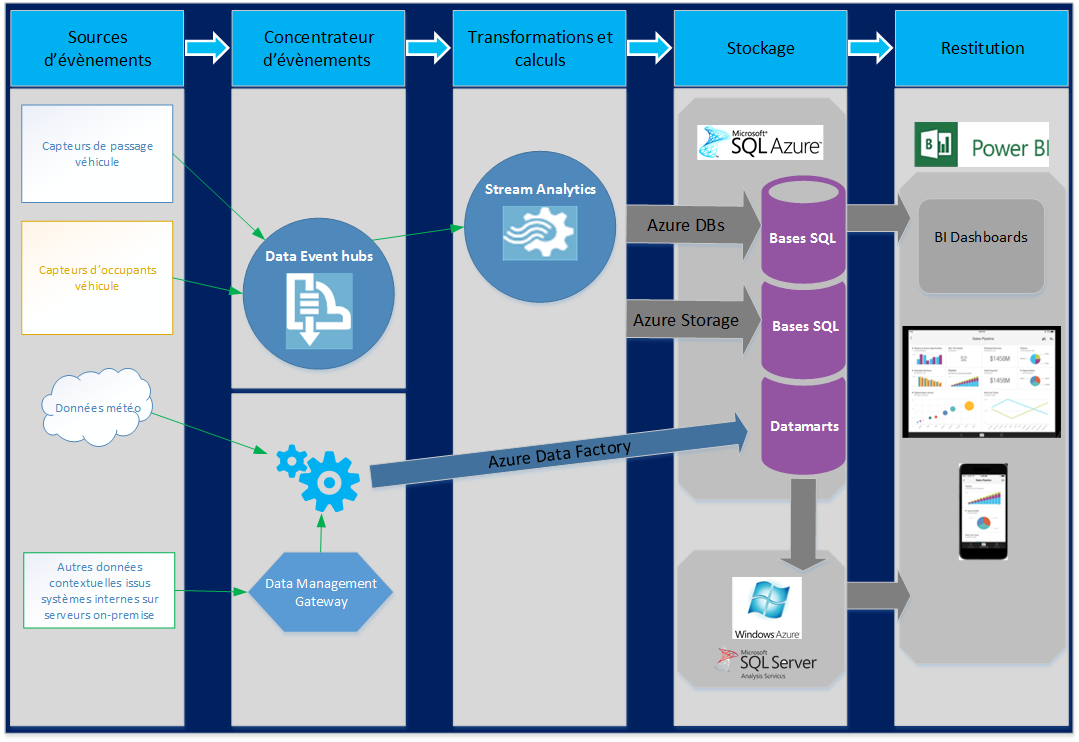

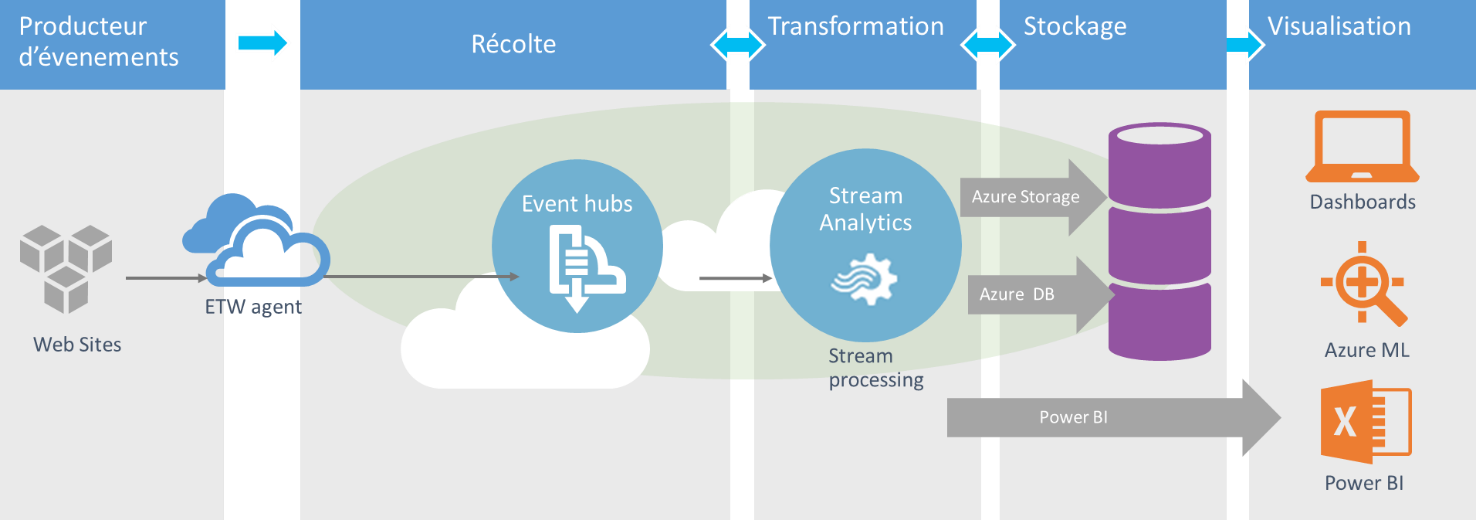

La solution décrite précédemment est architecturée de la manière suivante :

Azure Data Event Hub collecte et concentre l'ensemble des informations postées par les différents équipements issues des capteurs de passage et des capteurs permettant de dénombrer le nombre et le genre de personne par véhicule.

Stream Analytics est un système de type CEP (Complex Event Processing) qui permet d'appliquer des calculs métiers et des agrégations en temps réel, sur la base de l'ensemble des données collectées (https://azure.microsoft.com/fr-fr/services/stream-analytics/)

D'autres données issues de serveurs déjà implémentés On-premise.(https://azure.microsoft.com/fr-fr/services/event-hubs/) et des données météo sont traitées et injectées via Azure Data Factory.

Des magasins de données métier (Datamart) sont alors implémentés dans des bases de données Cloud SQL Azure (PAAS : Platform As A Service)

Une couche d'analyse basée sur SQL Server Analysis Services implémenté dans une infrastructure virtualisée Windows Azure Virtual Machine (IAAS : Infrastructure As A Service) et configurée pour tenir compte en temps réel des données chargées dans le Datamart.

Des tableaux de bord sont alors créés via Power BI. Ils consomment les données et indicateurs exposés par la couche d'analyse, via un connecteur Analysis Service.

Power BI permet une restitution multi-devices, permettant aux agents de terrain de recevoir et consulter les données via leur mobile.

Cette solution est architecturée autour d'une collection de services Cloud de Microsoft Windows Azure afin de proposer des fonctionnalités pouvant être rapidement mise en œuvre, capable de monter en charge et de s'adapter aux contraintes des équipes en mobilité.

D'autre part, ce type d'architecture gérée dans le cloud, permet de réduire les coûts :

Synthèse

Cet article a présenté une solution s'appuyant sur les nombreuses possibilités de la plateforme Cloud de Microsoft, Windows Azure, afin de proposer aux responsables de gestion du trafic les indicateurs nécessaires au pilotage des ressources et moyens nécessaire pour assurer la sécurité des usagers, la fluidité du trafic, la gestion financière des ressources aux meilleurs moments.

Produits concernés :

SQL Serveur sur Azure

SQL Server Analysis Services 2014

Windows Azure Event Hubs

Windows Azure Virtual Machine

Windows Azure Stream Analytics

Windows Azure Data Factory

Modern Apps

Power BI

Des solutions innovantes avec Microsoft Consulting Services

Les architectes et consultants MCS sont formés sur l'ensemble de l'offre applicative et infrastructure de Microsoft, afin de proposer à leurs clients des solutions innovantes permettant de répondre à leurs enjeux opérationnels, et de s'engager dans une démarche de transformation numérique.

Pour plus d'informations sur les offres packagées Microsoft Consulting Services, rendez-vous sur https://www.microsoft.com/france/services

Plus d'informations sur les blogs, rendez-vous sur « L'innovation par les données ».

| Hervé MARIE, Senior Consultant Data Insight, Microsoft Consulting Services Après une expérience de 9 ans en tant que responsable technique de compte en développement, j'ai rejoint MCS en 2006 pour me spécialiser en SQL Server afin d'accompagner nos clients dans la mise en œuvre d'architecture hautement disponible, d'architecture SQL & BI, de projets Azure |

L'innovation par les données – L'efficience du commerce en ligne par la mesure d'audience en temps réel

La mesure d'audience des sites internet a pour objectif d'aider les équipes marketing et vente d'une entreprise B2C à élaborer une stratégie commerciale à partir d'informations réelles comme par exemple les pages web ayant conduit au plus grand nombre d'achats.

Nous allons voir dans cet article comment construire une solution simple, agile et rapide d'analyses en temps réel du trafic à partir des fichiers logs provenant des sites Web, en s'appuyant sur des informations qui peuvent être exploitées sans aucune modification de code nécessaire sur le site.

Problématique

Convertir des visites en ventes ou inscriptions

Fournir une solution de reporting ad-hoc sur la fréquentation du site

Minimiser l'investissement sur l'infrastructure d'analyse d'audience

Bénéfices

Une prise de mesure qui ne pénalise pas l'expérience utilisateur des clients du site.

Le suivi en temps réel des événements et de l'audience d'un site web pour une meilleure réactivité

L'élasticité et l'agilité des services Cloud

L'analyse de fréquentation des sites web

Afin de mieux concentrer les efforts sur ce que les clients viennent chercher sur un site mais aussi dans le but de mieux connaître ses visiteurs et ses clients, tout site web cherchant à améliorer ses performances commerciales nécessite une mesure d'audience.

La première phase consiste à comprendre et à définir les objectifs que l'on souhaite mesurer. En fonction de la topologie du site web, les indicateurs à mesurer varient mais certains KPI apparaissent systématiquement tel que :

Nombres de visites.

Nombre de visiteurs.

Taux de rebond – taux de consultation d'une page web sans poursuite de la visite sur le site.

Taux de conversion – Ratio entre visiteurs et acheteurs.

Nombres de pages visitées.

Pages les plus visitées.

Pages les plus référencées.

Origine géographique des visiteurs.

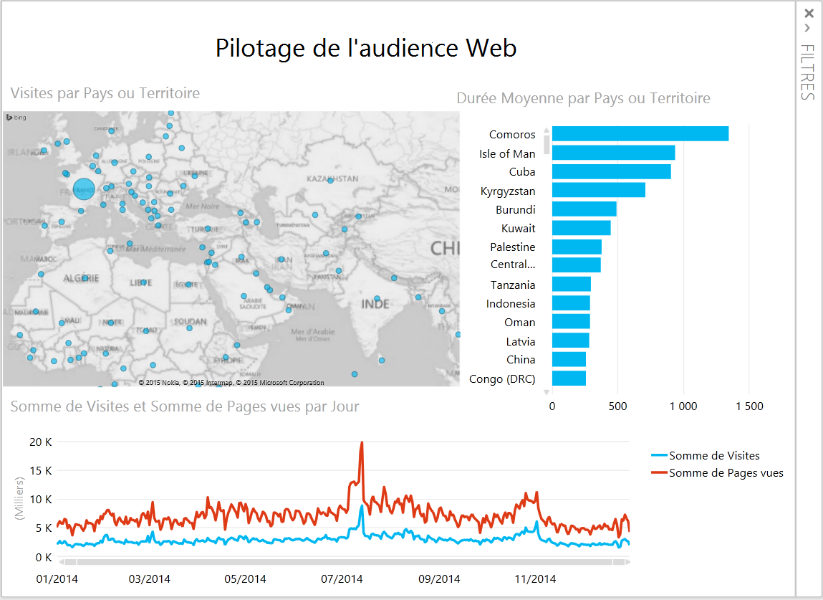

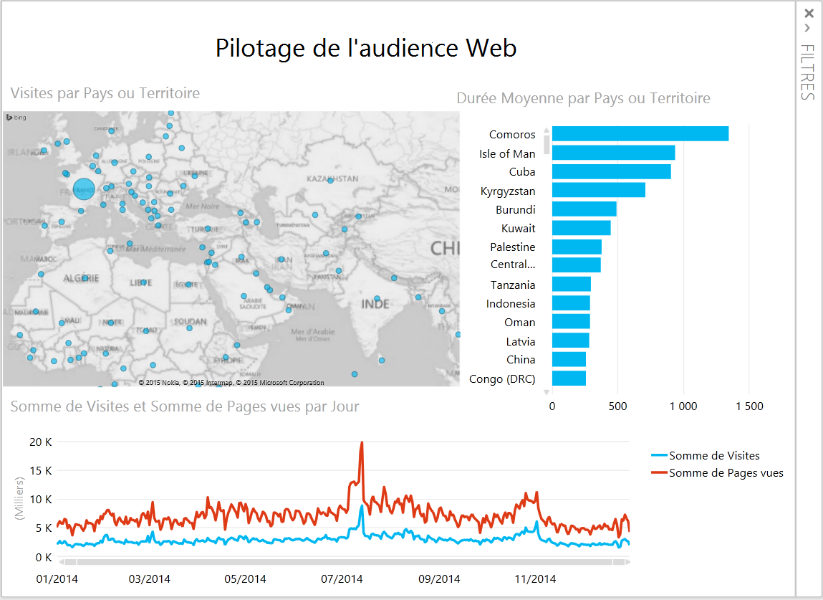

Figure 1 : Exemple de tableau de bord

L'analyse de ces mesures peut se faire selon différentes catégories d'axes:

Informations sur les visiteurs : Types de visiteurs (new vs returning), compteurs de visites…

Sources de trafic : Mots clés sur des moteurs de recherche, moyen d'arrivée (url tapée directement, moteur de recherche, lien sur un autre site…)…

Informations techniques : Navigateur utilisé, accès depuis un mobile, la langue, la localisation géographique, etc…

Chacun de ces axes d'analyses offre des possibilités d'analyses et la mise en place d'actions à tous les niveaux de l'entreprise.

Par exemple, on pourrait constater que certains utilisateurs ont du mal à accéder à leur panier lorsqu'ils utilisent le site web dédié au mobile ce qui entrainerait la refonte de cette partie.

On peut aussi se rendre compte que la stratégie de renvoi mise en place sur un site partenaire n'est pas aussi efficace qu'on pourrait l'imaginer.

Quoi qu'il en soit, l'analyse de ces indicateurs en temps réel permet de revoir sa stratégie et maximiser les revenus du site web.

Les équipes commerciales et marketing suivent les évolutions et tendances du trafic au fil de l'eau, les analysent et mettent en place des actions afin d'améliorer les performances du site ou de certaines campagnes avec une forte réactivité.

L'A/B testing est un exemple concret de l'agilité offerte par une analyse temps réel. « L'A/B testing » consiste à tester des modifications par rapport à une version actuelle.

Dans le cas d'une page d'inscription visiteur, cette technique permettra de valider que les modifications apportent un meilleur taux d'inscription ou de conversion.

La page initiale (A) et la page modifiée (B) sont déployées en production avec une répartition équilibrée des connexions utilisateurs. 50% des utilisateurs verront la page A et les autres 50% verront la page B.

On mesure ensuite la performance de chacune des variations sur un indicateur clé comme par exemple le taux d'inscription.

Figure 2 : Principe de l'A/B testing

Ces tests permettront de confirmer des hypothèses en se basant sur la perception des utilisateurs et prendre une décision par rapport à une conception A ou B.

Cette technique couplée à une solution de reporting temps réel permet de valider en direct la perception des utilisateurs. Cela représente un avantage compétitif non négligeable lors de périodes à fortes activités commerciales comme les soldes ou durant les fêtes de fin d'année.

Ces tests permettront de confirmer des hypothèses en se basant sur la perception des utilisateurs et prendre une décision par rapport à une conception A ou B. Cette technique couplée à une solution de reporting temps réel permet de valider en direct la perception des utilisateurs. Cela représente un avantage compétitif non négligeable lors de périodes à fortes activités commerciales comme les soldes ou durant les fêtes de fin d'année.

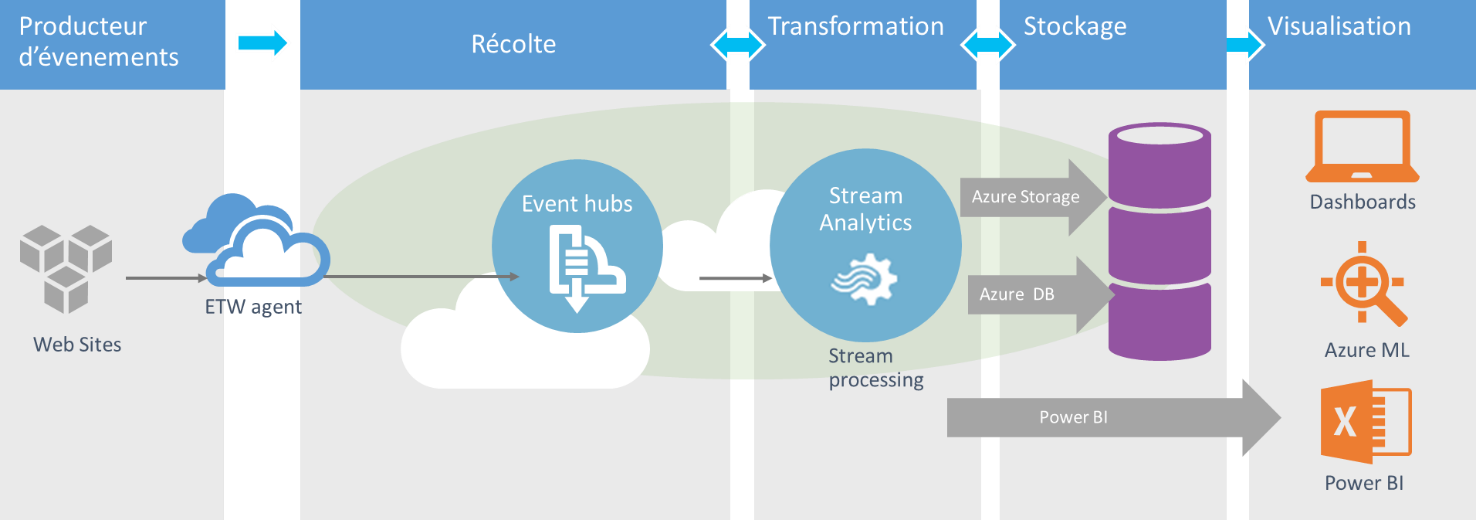

Architecture de la solution

La solution présentée dans cet article repose sur un ensemble de services proposés par la plate-forme Cloud Microsoft Azure permettant la prise en charge en temps réel d'évènements, et pouvoir par la suite représenter ces données via des restitutions innovantes.

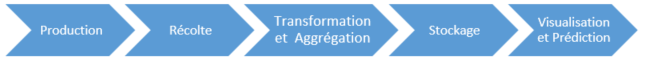

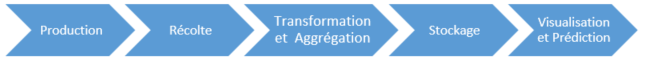

Nous allons découper la solution en 5 strates:

La production d'évènement, provient du service Web IIS qui génère en temps réel des traces d'évènements pour Windows (Event Tracing for Windows).

La récolte d'évènements, repose sur un agent local qui transmet les évènements ETW dans le service cloud Microsoft Azure Event Hub, qui permet d'ingérer et stocker plusieurs millions d'événements par secondes provenant de plusieurs sites Web différents.

La transformation et l'aggrégation, qui s'appuie sur le service Microsoft Azure Stream Analytics permettant de traiter le flux d'évènements en temps réel. Ce service, très simple et rapide à mettre en place, permet d'interroger le hub hub avec de simples requêtes SQL de transformation et d'aggrégation.

Le stockage, une fpis les évènements traités, dans un service de base de données Microsoft Azure Database pour des analyses croisées avec un référentiel et/ou dans du stockage Azure pour de l'archivage de données.

La visualisation, en restituant l'ensemble du processus en amont sur Power Bi, un outil de visualisation dynamique et accessible même en mobilité. La sortie temps réel depuis Stream Analytics est en phase d'évaluation privée (preview)

Figure 3 : Architecture de la solution

Le choix du Cloud Microsoft permet :

De construire une solution modulable et performante adaptée à tous les scénarios

Une maitrise des coûts

Des fonctionnalités innovantes

Un déploiement rapide de la solution

Evolution de la mesure d'audience

Une fois le système de mesure d'audience mis en place, certaines évolutions peuvent voir le jour, telles que la mise en place de système d'apprentissage ou Machine Learning.

Microsoft Azure Machine Learning permet de prédire et anticiper des événements à l'aide de l'historique des données stockées auparavant. Dans le cadre de la mesure d'audience, les exemples sont multiples :

Détection des caractéristiques des utilisateurs les plus impactant vis-à-vis de certains indicateurs de performances (KPI).

Anticipation de flux de visiteurs importants pour provisionner un nombre plus important de machines et répondre ainsi au besoin des utilisateurs sans dégradation ou interruption de services.

Reconnaissance d'activités suspicieuses afin d'éviter les tentatives de fraudes…

Identification de situation potentielle d'attaque de déni de service

On peut aussi à l'aide de nouveaux outils de visualisations comme Power Map, s'ouvrir d'autres portes dans la visualisation des données de mesure d'audience de site web.

Comme on peut le constater sur l'image ci-dessous, il est possible de modifier l'image de fond de l'outil Power Map afin d'utiliser une image personnalisée et afficher l'image de son site web et retracer le déplacement de souris de l'ensemble des utilisateurs.

Figure 4 : Représentation du Cursor Tracking

Cette pratique permet de mieux comprendre comment les utilisateurs se déplacent sur le site et comprendre si son ergonomie est adaptée au public visé.

Synthèse

Cet article a présenté une solution de mesure d'audience de sites Web la moins intrusive possible pour les équipes IT, tout en offrant une expérience unique aux directions commerciales et marketing.

Produits concernés :

Des solutions innovantes avec Microsoft Consulting Services

Les architectes et consultants MCS sont formés sur l'ensemble de l'offre applicative et infrastructure de Microsoft, afin de proposer à leurs clients des solutions innovantes permettant de répondre à leurs enjeux opérationnels, et de s'engager dans une démarche de transformation numérique.

Pour plus d'informations sur les offres packagées Microsoft Consulting Services, rendez-vous sur https://www.microsoft.com/france/services. Nous vous invitons à y consulter notamment les diverses offres CRM et Business Analytics proposées.

Pour plus d'informations sur les blogs « L'innovation par les données », rendez-vous sur L'innovation par les données .

Christian François, Consultant Data Insight, Microsoft Consulting Services

J'interviens dans du conseil en avant-vente, architecture et expertise avancée auprès des grands comptes ce qui m'a permis d'acquérir une forte expérience des projets d'infrastructure et de développement d'application SQL Server à haute criticité. J'ai été l'un des premiers certifiés SQL Ranger en 2007.

Marc Mineo, Consultant Data Insights, Microsoft Consulting Services

Issu du graduate program de Microsoft (programme MACH), permettant d'intégrer des jeunes diplômés tout en leur offrant une formation riche pour une meilleure intégration dans l'entreprise, je participe à des missions en tant qu'expert sur les outils de Business Intelligence, avec un certain attrait pour la visualisation des données et la conception de bases de données multidimensionnelles

Omar Battoum, Consultant Data Insights, Microsoft Consulting Services

Issu du programme MACH au sein de Microsoft, j'interviens dans les projets de business intelligence et d'analyse de données en libre-service.

Jivane Rajabaly, Consultant Modern Apps, Microsoft Consulting Services

Spécialisé dans la modernisation des applications, j'interviens dans des missions de conseil en architecture et expertise sur du développement .NET, la gestion du cycle de vie des applications (ALM /TFS), Windows Azure et Biztalk.

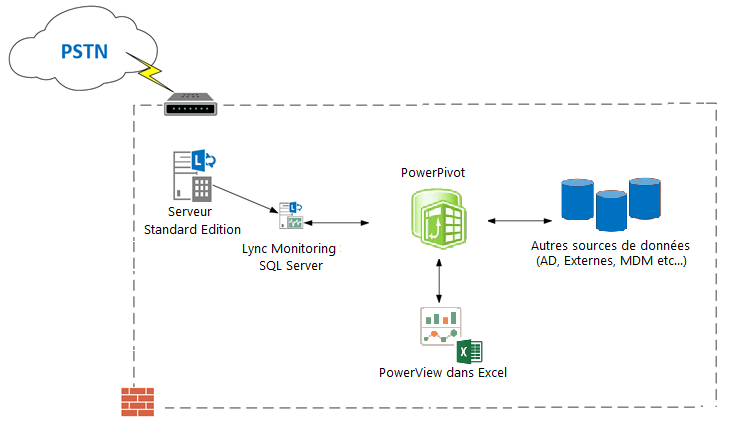

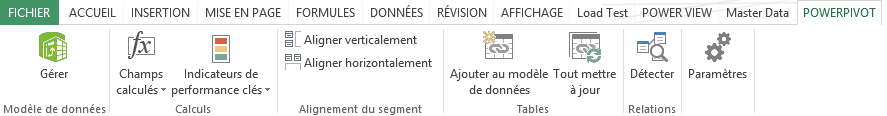

L'innovation par les données - Piloter efficacement sa plateforme de communication

Avec l'explosion de la production de données, les entreprises souhaitant accroitre leur productivité se doivent d'exploiter efficacement et de valoriser au maximum l'énorme potentiel que représentent ces amas de données.

La plateforme de communication Lync de Microsoft est un très bon exemple, puisqu'elle génère beaucoup de données particulièrement pertinentes en termes d'activité opérationnelle, mais restants bien souvent inexploitées.

Cet article a pour objectif de présenter un complément à la fonctionnalité native de reporting de la plateforme Lync, reposant sur SQL Server Reporting Services.

La méthodologie présentée dans cet article va permettre de tirer le potentiel de ces données de manière simple, souple, et en mesure de répondre à des besoins spécifiques d'analyse, que ce soit en termes de pilotage, de supervision et de refacturation.

Problématique

Lync fournit nativement de nombreux rapports afin d'exploiter les données collectées par le serveur de monitoring.

Ces rapports ont été pensés et créés afin de répondre à la majorité des recherches d'information sur l'infrastructure Lync.

Toutefois, devant la diversité des données disponibles, toutes ne sont pas exploitées ni « corrélées » de la manière attendue par certains clients.

Il devient ainsi nécessaire de créer de nouveaux rapports, présentant les indicateurs demandés l'utilisateur, sous une forme adaptée à son besoin propre. Voici 4 exemples de rapports pouvant illustrer cette problématique :

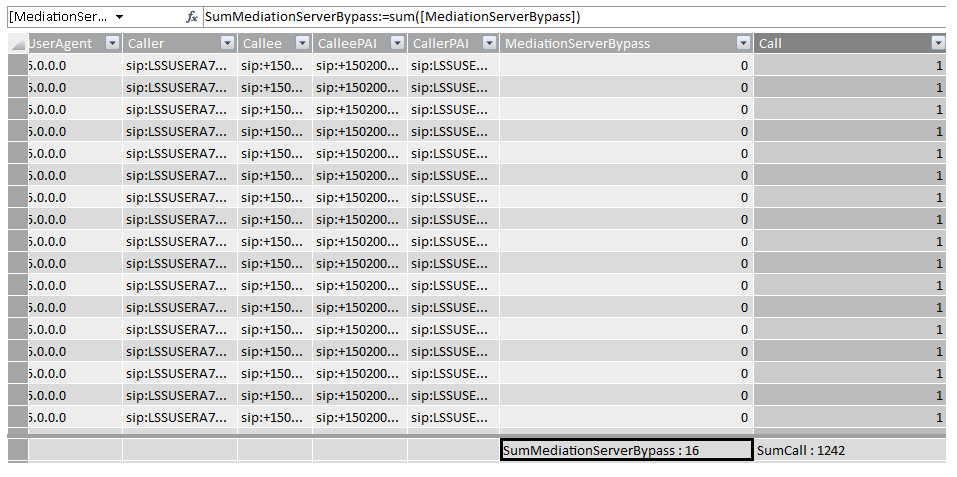

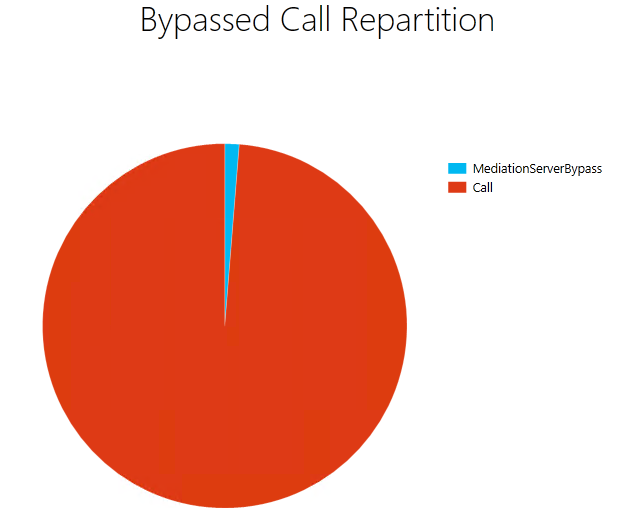

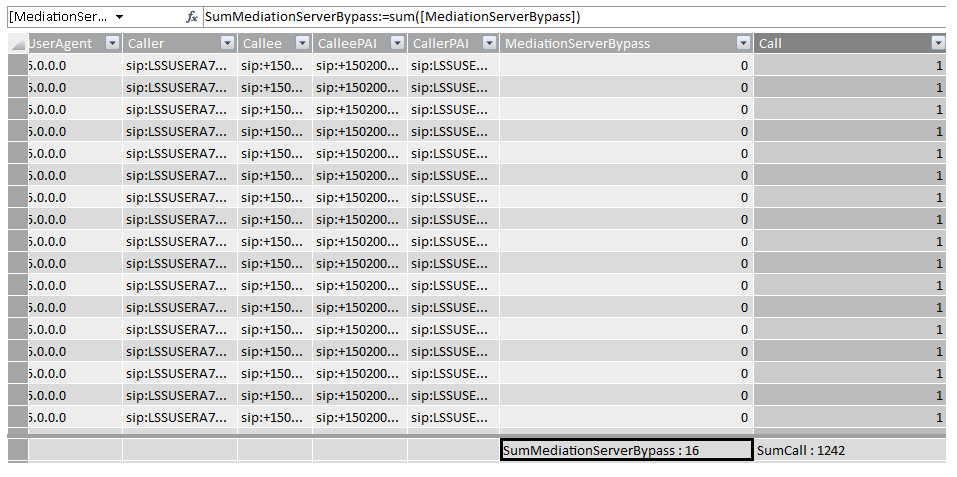

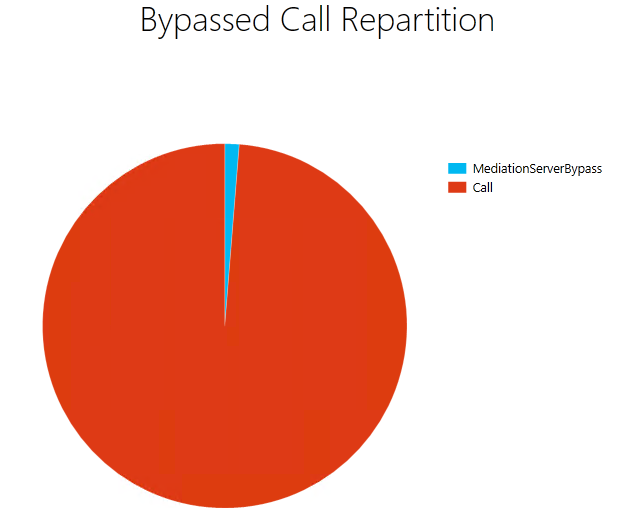

- Visualiser le nombre d'appels Bypassé : l'appel Bypassé est un appel acheminé directement au client sans passer par l'intermédiaire de serveur Lync, économisant ainsi des ressources sur l'infrastructure Lync. Il est alors intéressant de visualiser le nombre d'appel « Bypassé » et d'identifierles conditions ou le Bypass n'a pas été possible.

- Fournir le niveau de détail des appels nécessaire pour la refacturation : fournir le temps passé en communication par utilisateur et par zone appelée (mobile, international…) : cela permet de fournir une solution simple pour refacturer les appels en interne.

- Présenter une vue du nombre de discussions avec des interlocuteurs fédérés : Certainsclients adoptant la fédération avec d'autres entités désirent quantifier la nature et le volume d'interactions avec leurs partenaires.

- Créer un tableau de bord interactif et synthétique des données nécessaires à la supervision : La vue synthétique sous forme de tableau de bord permet aux responsables du support de surveiller efficacement et rapidement les indicateurs critiques de bonne santé de l'infrastructure Lync.

Bénéfices

- Accéder facilement et simplement aux données de monitoring de Lync

- Avoir la possibilité de croiser ces données avec une multitude de données issues d'autres systèmes

- S'affranchir de solution tierce pour le calcul de refacturation

- Accroitre l'efficacité de la supervision en proposant des tableaux de bord clairs et interactifs

- Avoir une solution souple pouvant évoluer au fil des besoins

- Profiter des possibilités collaboratives de la plateforme applicative de Microsoft

La collecte de données dans Lync

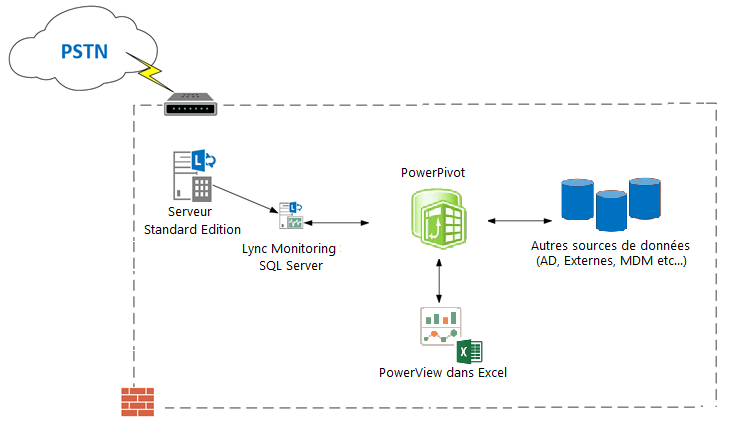

Lync est une solution de messagerie instantanée, conférence, web conférence et voix sur IP disponible OnPremise et dans le cloud. Sa déclinaison OnPremise propose un serveur de monitoring, véritable mine d'information concernant l'infrastructure. En effet, ce serveur collecte l'ensemble des activités sur la solution ainsi que la qualité des échanges.

Ces données sont exploitées par les équipes d'administration pour :

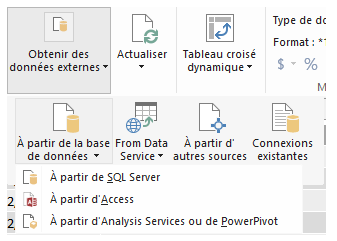

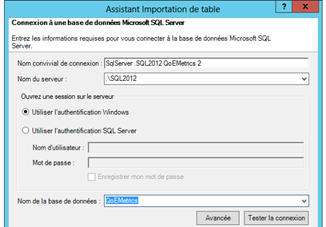

- Surveiller la qualité du service délivré

- Identifier les pannes et disfonctionnements